Gli elevati costi del settore IT sono spesso da imputare ad un forte spreco di risorse aziendali. In genere, tale dispendio è causato anche da un improprio investimento su nuovi hardware e su nuovi server, soprattutto perché le macchine vengono sfruttate solo in parte rispetto alla loro effettiva potenzialità.

Secondo i risultati di indagini condotte da diverse società di analisi, i server presenti in azienda vengono adoperati solo per un 30% delle reali possibilità, causando sprechi dovuti al consumo energetico, alle risorse hardware non utilizzate ed agli eccessivi costi di gestione.

Ecco perché, sempre più manager IT guardano a nuove forme di distribuzione dei carichi di lavoro fra le differenti macchine dislocate all’interno di una rete, sia per consentire il massimo utilizzo di ogni singola risorsa, sia per economizzare la gestione ed i costi latenti dei mezzi a disposizione.

Per incentrare i carichi di lavoro aziendali su poche macchine ed evitare di ricorrere a differenti server che gestiscano separatamente workload in realtà associabili, una delle migliori soluzioni è l’applicazione dei sistemi di virtualizzazione , che permettono di ottimizzare il TCO dell’hardware già disponibile nella propria infrastruttura.

Microsoft , nel tentativo di venire incontro ad ogni tipo di esigenza e di massimizzare la flessibilità e l’avanzamento delle strutture IT, riducendone costi e tempi di fermo, sta puntando molto sulle soluzioni di virtualizzazione.

Esse sono sempre scalabili e adottabili da aziende di qualsiasi dimensione.

Per dimostrarne la flessibilità di adattamento alle esigenze più disparate di organizzazioni di diverso tipo, la casa di Redmond ha pensato di offrire ai responsabili IT una raccolta di guide che chiarisca come sia facile conseguire gli obiettivi aziendali di risparmio sui costi e di aumento della disponibilità computazionale, semplicemente adottando in azienda le diverse proposte di virtualizzazione.

Queste guide esemplificano:

– la riduzione dei costi e della complessità con i Remote Desktop Severvices

– il risparmio di energia grazie al consolidamento dei server

– l’aumento della disponibilità computazionale a supporto di una crescita improvvisa

– il miglioramento dell’utilizzo dei server e la riduzione del TCO dell’infrastruttura

– la virtualizzazione di SharePoint a supporto di una nuova sede

– la migrazione dei dati archiviati

– la virtualizzazione di Exchange

– la pianificazione del Disaster Recovery

SharePoint ed Exchange Server: supporto alle aziende multi-sede

Uno dei problemi maggiormente sentiti dalle aziende multi-sede è la necessità di mettere a disposizione dei propri collaboratori gli stessi strumenti software indipendentemente dall’ufficio nel quale si trovano a lavorare. Dilemma che obbliga le organizzazioni a distribuire hardware dedicato, aumentando di conseguenza i costi relativi agli uffici periferici e complicandone anche la gestione dal punto di vista delle infrastrutture IT.

Di contro, qualora la struttura informatica nelle differenti sedi non sia uniforme e non permetta al personale di accedere alle medesime applicazioni, i dipendenti si trovano obbligati a viaggiare fra i differenti uffici, con un relativo aumento dei costi di trasferta e degli orari lavorativi. Microsoft propone una soluzione di virtualizzazione dedicata che si presenta proprio come supporto per tali esigenze. Il tutto, offerto attraverso Windows Server 2008 R2, Hyper-V e i Remote Desktop Services (RDS) .

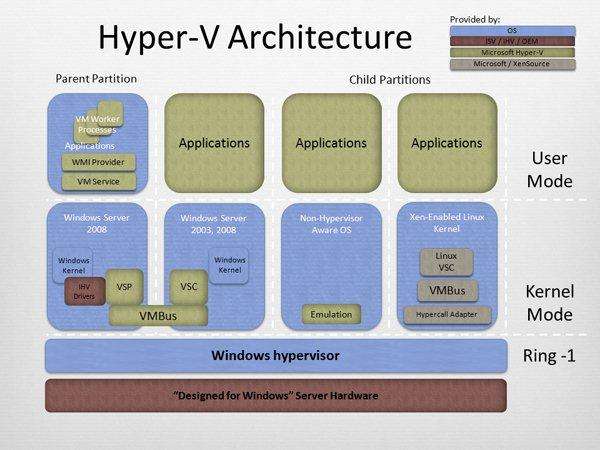

Hyper-V è una piattaforma di virtualizzazione installabile su hardware fisico e capace di emulare fino a 384 virtual machine per host disponibile. Con questo strumento è possibile configurare la capacità della memoria, dello spazio di archiviazione e del processore, clonare e distribuire configurazioni di macchine virtuali per espandere velocemente le risorse adoperabili e sfruttare al massimo le infrastrutture IT già disponibili.

Hyper-V è un hypervisor “bare metal” che si installa direttamente sull’hardware. È composto da microkernel ed è compreso in Windows Server 2008 e Windows Server 2008 R2

I Remote Desktop Services , invece, sono l’evoluzione dei tradizionali Terminal Services e permettono agli utenti di usufruire di un desktop virtualizzato (VDI) e delle corrispondenti applicazioni, accedendo ad un server da qualsiasi client a disposizione.

Un server consolida quindi innumerevoli sessioni di altrettanti utenti, che accedono alle proprie applicazioni indipendentemente dalla loro ubicazione in modo protetto e senza l’uso di hardware dedicato.

In questo modo, i client distribuiti nelle sedi satellite possono anche non essere di ultima generazione, contenendo notevolmente i costi, in quanto l’esigenza di potenza computazionale sarà a completo carico del server sul quale sono virtualizzati i desktop e le applicazioni.

Al contempo, i dipendenti potranno accedere ai dati di lavoro ed al software da qualsiasi luogo si trovino, evitando di dover compiere trasferte inutili fra i differenti uffici.

Il reparto IT sarà agevolato negli aggiornamenti dalla sede centrale e nel controllo delle licenze, riducendo significativamente la quantità di dati che passano attraverso Internet.

Allo stesso modo, i reparti IT saranno capaci di offrire agli uffici remoti non solo postazioni client in virtualization, ma anche ambienti server.

Ad esempio, è possibile virtualizzare Microsoft Exchange Server per fornire ad ogni ufficio un ambiente protetto e gestito di posta elettronica e calendario. Inoltre, con un solo computer e Windows Server 2008 R2 è possibile virtualizzare anche SharePoint per collaborare in remoto, accedere a risorse documentali ed usufruire di applicazioni che, in passato, erano fruibili solo ed esclusivamente operando un’installazione locale dei prodotti.

Il risultato è una netta riduzione dei costi e dei tempi ed un miglioramento della flessibilità dell’intera organizzazione, anche a vantaggio degli orari lavorativi. Come già detto, troppo spesso le aziende ricorrono all’acquisto di nuovi server, piuttosto che investire sulle infrastrutture esistenti, sia per implementare nuove funzionalità e OS, sia per mantenere le strutture IT al passo con i cambiamenti dei mercati tecnologici e dei bisogni di business. Così, nel corso degli anni, l’infrastruttura informatica aziendale si arricchisce via via di nuove macchine e i costi di gestione crescono.

Questi ultimi aumentano anche come conseguenza del maggiore consumo energetico richiesto da ogni nuovo server installato e dalle sue periferiche. Tale consumo è dovuto non solo all’alimentazione necessaria al funzionamento della macchina stessa, ma anche all’energia elettrica richiesta dai sistemi di raffreddamento, indispensabili per un corretto mantenimento dell’hardware.

Inoltre, inserire nuovi server significa anche moltiplicare in modo esponenziale le esigenze di connettività, aumentando il traffico di rete e i conseguenti conflitti tra i dati in transito.

Tutte queste problematiche vengono automaticamente a decadere nel momento in cui le aziende decidono di affidarsi alle soluzioni di virtualizzazione con le quali Microsoft rende capaci i reparti IT di consolidare differenti workload in un numero di server più compatto, riducendo gli sperperi di energia elettrica e la complessità dell’infrastruttura.

Ad esempio, ad un server Web occupato durante la settimana ed inutilizzato nel weekend, possono essere assegnati importanti processi di elaborazione di database, che occuperanno le medesime risorse computazionali dal venerdì alla domenica.

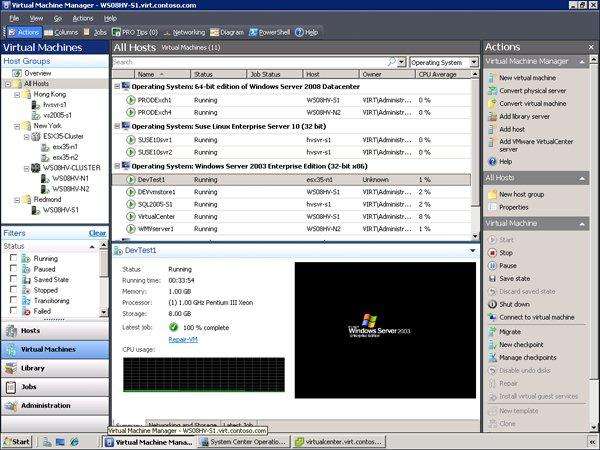

L’adozione di Windows Server 2008 R2, Hyper-V, System Center Virtual Machine Manager 2008 R2 e System Center Self-Service Portal 2.0 permette di convertire i carichi di lavoro esistenti in macchine virtuali , consolidate in un unico server ed eseguite secondo un ordine preimpostato. In questo modo, ogni workload diventa semplicemente un processo di lavoro a carico di una singola macchina.

Raggruppare istanze virtuali di server in un’unica macchina fisica, permette di trarre beneficio non solo dal punto di vista energetico, ma anche dal punto di vista dei costi di manutenzione e delle prestazioni, aumentando il ROI ed offrendo un servizio IT più flessibile.

Se cresce improvvisamente la domanda IT…

Una crescita repentina del business implica evidentemente una crescita della struttura aziendale che deve essere supportata da un’infrastruttura IT opportunamente dimensionata alle nuove esigenze.

Nel caso in cui il sistema IT a sostegno dell’organizzazione non sia più sufficiente a far fronte alle richieste degli utenti, i responsabili del settore informatico si trovano costretti a richiedere nuovi budget di investimento, per aggiungere nuovi server in grado di soddisfare la crescente domanda di servizi.

Questo approccio classico comporta un investimento di capitale e, comunque, potrebbe risultare inefficiente, in quanto si basa su previsioni di carico e di utilizzo che possono essere verificate solo con l’uso effettivo del nuovo hardware acquistato.

Anche in questo ambito , la piattaforma di virtualizzazione Hyper-V , insieme a Windows Server 2008 R2 , sembra offrire l’approccio più corretto, in quanto permette di rendere disponibili risorse IT laddove se ne verifichi l’effettiva necessità, senza dover affrontare nuove capitalizzazioni.

Si ottimizza così l’hardware già disponibile e si viene incontro alle necessità dettate da una crescita improvvisa, permettendo agli utenti di accedere contemporaneamente ad una stessa risorsa, senza inutili attese. Un’altra fondamentale attività alla quale il settore IT deve provvedere all’interno di un’azienda è la definizione di un piano di migrazione dei dati archiviati e di un sistema di disaster recovery in caso di errore. Entrambe le occupazioni non richiedono specifiche competenze ma, se sottovalutate, potrebbero celare problemi in grado di portare ad una situazione di stallo dell’intera infrastruttura.

Ad esempio, nell’ambito dell’archiviazione, la semplice attività di trasferimento dei dati fisici da un percorso ad un altro implica problemi di spazio e di compatibilità fra i sistemi operativi, fra i tipi di archiviazione e fra i relativi formati gestiti dalle macchine di origine e di destinazione del processo. Queste problematiche sono ulteriormente complicate dalla presenza di altri inconvenienti a carico delle macchine virtuali: non è possibile spostare dati da una macchina virtuale quando questi sono in uso, perché si rischia di generare gravi errori.

Anche in questo scenario , la tecnologia Microsoft viene incontro alle esigenze lamentate dai clienti, grazie al System Center Virtual Machine Manager 2008 R2 . Questo componente evita agli amministratori la necessità di dover pianificare i tempi di inattività durante i quali gestire lo spostamento dei file da archiviare. Inoltre, la funzionalità integrata di Quick Storage Migration (QSM) consente di spostare macchine virtuali da un percorso di archiviazione ad un altro, senza incorrere in errori.

La gestione di server di virtualizzazione basati su Hyper-V può essere effettuata usando un’apposita management console disponibile in System Center Virtual Machine Manager 2008 R2

Questi sono, infatti, il maggiore incubo dei responsabili IT, soprattutto perché potrebbero essere correlati ad una perdita di dati, tale da impedire l’uso di alcune parti o dell’intera infrastruttura, obbligando a tempi di fermo tecnico dilatati e a perdite di performance a livello di business aziendale.

Occorre progettare nei minimi dettagli i piani di disaster recovery. Anche in questo ambito, la virtualizzazione semplifica notevolmente alcune fasi di pianificazione ed offre al settore IT la capacità di distribuire e trasferire una copia di un’immagine virtuale da un server down ad uno funzionante, accelerando il processo di ripristino e comprimendo i tempi di fermo tecnico ed il rischio di perdita dati. Questa funzionalità, insieme a molte altre, viene offerta dal Microsoft System Center Data Protection Manager 2010 , studiato da Redmond per semplificare le attività di archiviazione e disaster recovery di macchine fisiche e virtuali.