Google ha finalmente dato a Gemini il potere di riconoscere se un’immagine è stata generata dall’intelligenza artificiale. Suona come una grande vittoria nella guerra contro le fake news e i contenuti sintetici che proliferano online come erbacce, vero? Beh, c’è un piccolo dettaglio, per ora funziona solo con le immagini create o modificate dall’intelligenza artificiale di Google… è già qualcosa.

L’App Gemini scova le immagini AI con SynthID, ma funziona solo per i contenuti creati con l’AI di Google

L’app Gemini è stata aggiornata con questa funzione che sfrutta SynthID, una tecnologia di watermarking che Google ha introdotto nel 2023. SynthID incorpora segnali impercettibili nei contenuti generati dall’AI, che rimangono intatti anche dopo modifiche, crop, filtri e tutti quei trucchetti che la gente usa per mascherare l’origine delle immagini. È come un tatuaggio invisibile che solo Google può vedere, e che persiste anche se si prova a cancellarlo con Photoshop.

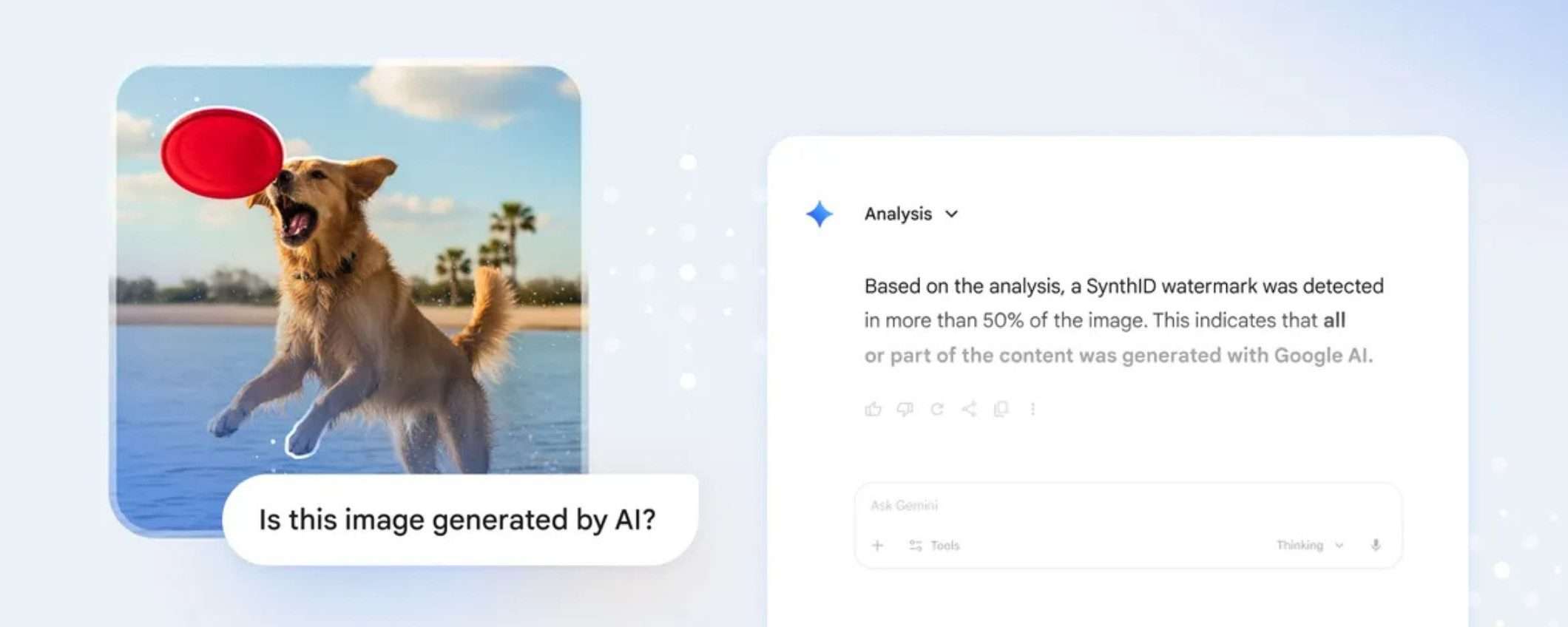

Usare il rilevatore è semplicissimo. Basta caricare un’immagine nell’app Gemini e chiedere È stata creata con l’AI di Google?

o È stata generata dall’AI

. Il chatbot controllerà la filigrana SynthID nell’immagine e userà le sue capacità di ragionamento per dare una risposta che aggiunga contesto. Non è solo un sì o no secco, ma una spiegazione che dice cosa ha trovato e perché pensa che l’immagine sia o meno generata dall’intelligenza artificiale.

SynthID è stato testato sul campo attraverso un portale aperto a giornalisti, ricercatori e professionisti dei media da inizio anno. Lo strumento identifica contenuti creati dall’intelligenza artificiale su più formati e segnala le sezioni dove il watermark digitale risulta più riconoscibile. Funziona persino su materiale pesantemente modificati o compressi, un aspetto cruciale, visto che le immagini che circolano online sono quasi sempre rielaborate rispetto all’originale.

Il problema dell’ecosistema chiuso

Il limite più grosso è che attualmente SynthID funziona solo per i contenuti generati dall’AI DI Google. Se qualcuno crea un’immagine con ChatGPT, Midjourney, DALL-E o qualsiasi altro generatore di immagini AI, Gemini non potrà farci nulla, almeno per ora.

Google è consapevole del problema e sta lavorando per risolverlo. In futuro, l’azienda utilizzerà il suo strumento SynthID Detector per supportare più tipi di contenuti, inclusi audio e video, e integrerà la funzione nella Ricerca Google e in altri prodotti. Ma soprattutto, aggiungerà il supporto per lo standard C2PA (Coalition for Content Provenance and Authenticity), che è un sistema aperto condiviso da Adobe, OpenAI, Meta, Microsoft e altri big della tecnologia.

C2PA è uno standard aperto che allega metadati sicuri a immagini, audio o video, certificando la loro provenienza e le modifiche subite nel tempo. È come un certificato di autenticità digitale che viaggia con il contenuto e che tutti possono leggere, non solo l’azienda che ha creato l’immagine. Adobe ha già sviluppato il proprio strumento di watermarking basato su credenziali C2PA, e Google sta implementando lo standard in prodotti come YouTube, Search, Pixel e Foto.

Il nuovo modello di generazione di immagini di Google, Nano Banana Pro, incorporerà i metadati C2PA nei contenuti generati dall’app Gemini, da Vertex AI e da Google Ads. Come afferma Big G, una volta che Google integrerà completamente le credenziali C2PA nei suoi strumenti di verifica, gli utenti potranno verificare la fonte originale dei contenuti creati da modelli e prodotti che esistono al di fuori dell’ecosistema di Google.

La corsa alla trasparenza dei contenuti AI

Google non è sola in questa crociata. La crescente minaccia dei contenuti generati dall’intelligenza artificiale che ingannano gli utenti ha risvegliato tutte le grandi aziende tech. Google è membro del comitato direttivo di C2PA insieme ad Adobe, OpenAI, Meta, Microsoft e altri. È una di quelle rare occasioni in cui i giganti della tecnologia stanno effettivamente collaborando invece di farsi guerra a colpi di brevetti e cause legali.

Il motivo è semplice: i contenuti sintetici sono diventati così convincenti che distinguere ciò che è reale da quello che non lo è, è sempre più difficile. Deepfake di politici, immagini generate che sembrano fotografie autentiche, video manipolati che diffondono disinformazione, tutto questo sta erodendo la fiducia delle persone. Le aziende tech sanno che se non affrontano il problema ora, la situazione peggiorerà al punto che nessuno crederà più a nulla online, il che sarebbe un disastro sia per gli utenti che per il loro modello di business basato sulla pubblicità.

SynthID e C2PA sono passi nella direzione giusta, ma non sono soluzioni perfette. I watermark digitali possono essere aggirati da malintenzionati sufficientemente determinati. Gli standard aperti richiedono che tutti li adottino volontariamente, e c’è sempre qualcuno che decide di non collaborare. E poi c’è il problema dei contenuti generati da AI open source che girano su hardware personale senza alcun tipo di tracciamento o watermarking.

Ma per ora, avere uno strumento in Gemini che ti dice se un’immagine è stata generata o modificata con l’intelligenza artificiale è meglio di niente. E quando il supporto C2PA arriverà, la funzione diventerà effettivamente utile per rilevare contenuti provenienti da tutto l’ecosistema AI.