Arriva dalla collaborazione tra la National University of Singapore e la Neuromorphic Research Community di Intel l’annuncio di nuovi studi che testimoniano la possibilità di applicare alla robotica la visione event-based e una sensibilità tattile abbinate al computing neuromorfico.

Intel Loihi: computing neuromorfico e pelle artificiale

Un’innovazione di questo tipo consente di ottenere unità ben più evolute rispetto a quelle attuali, potenzialmente in grado ad esempio di afferrare gli oggetti con la giusta pressione o di percepire l’ambiente circostante migliorando l’interazione in ambiti come la cura della persona. Questo il commento di Mike Davies, Direttore dell’Intel Neuromorphic Computing Lab.

Questa ricerca della National University of Singapore ci offre un interessante sguardo nel futuro della robotica, dove le informazioni sono sia percepite sia elaborate sulla base degli eventi combinando molteplici modalità. Questo lavoro porta nuova evidenza di come il calcolo neuromorfico consenta di ottenere notevoli miglioramenti in termini di latenza e di consumi energetici, quando si riprogetta l’intero sistema secondo un paradigma basato sugli eventi che comprende sensori, formati dei dati, algoritmi e architettura dell’hardware.

Si parla di pelle artificiale, componente che richiederà per forza di cose un processore in grado di trarre conclusioni accurate e in tempo reale sulla base dei dati rilevati dai sensori presenti sulla superficie, mantenendo bassi i consumi.

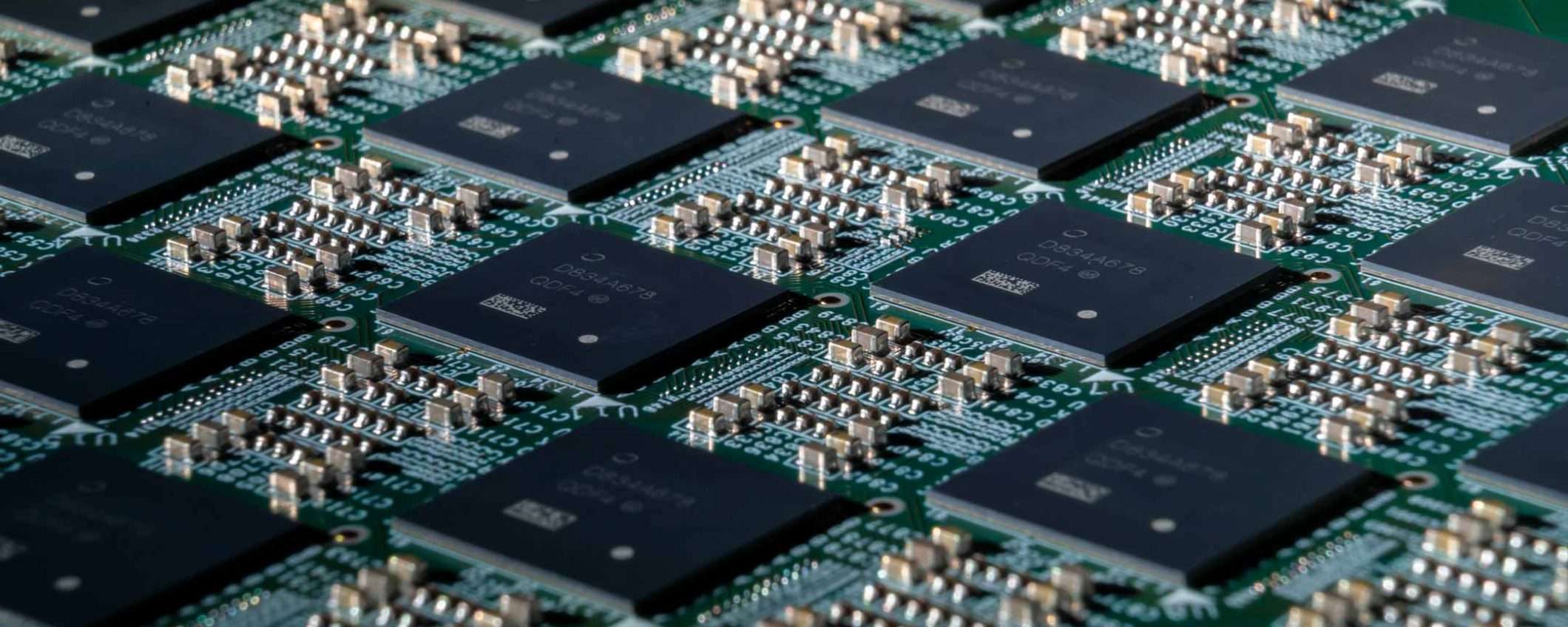

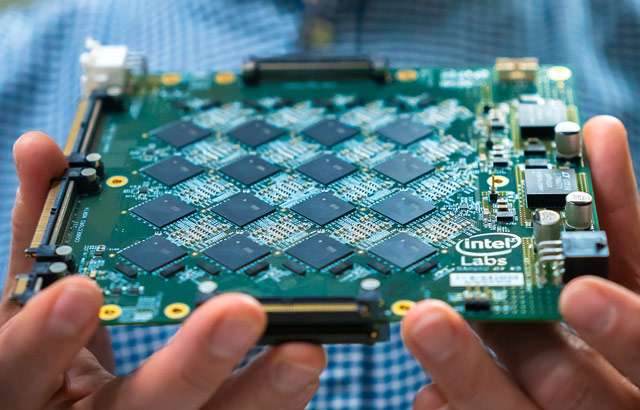

La ricerca si basa sull’impiego dello stesso chip Loihi progettato da Intel e già oggetto di una sperimentazione finalizzata alla creazione di un apparato hardware capace di riconoscere gli odori.

… il team di NUS ha ulteriormente migliorato le capacità di percezione robotica combinando i dati visivi a quelli tattili nella rete neurale. Per fare ciò, hanno incaricato un robot di classificare vari contenitori opachi contenenti diverse quantità di liquido, utilizzando input sensoriali dalla pelle artificiale e una telecamera basata su eventi.

Le informazioni sensoriali acquisite sono state trasmesse a una GPU e al chip neuromorfico per confrontare le capacità di elaborazione. Il chip Loihi è uscito a testa alta dal confronto: +21% nella rapidità del calcolo rispetto alle GPU più recenti, +45% di consumo energetico e +10% di precisione nella classificazione degli oggetti.