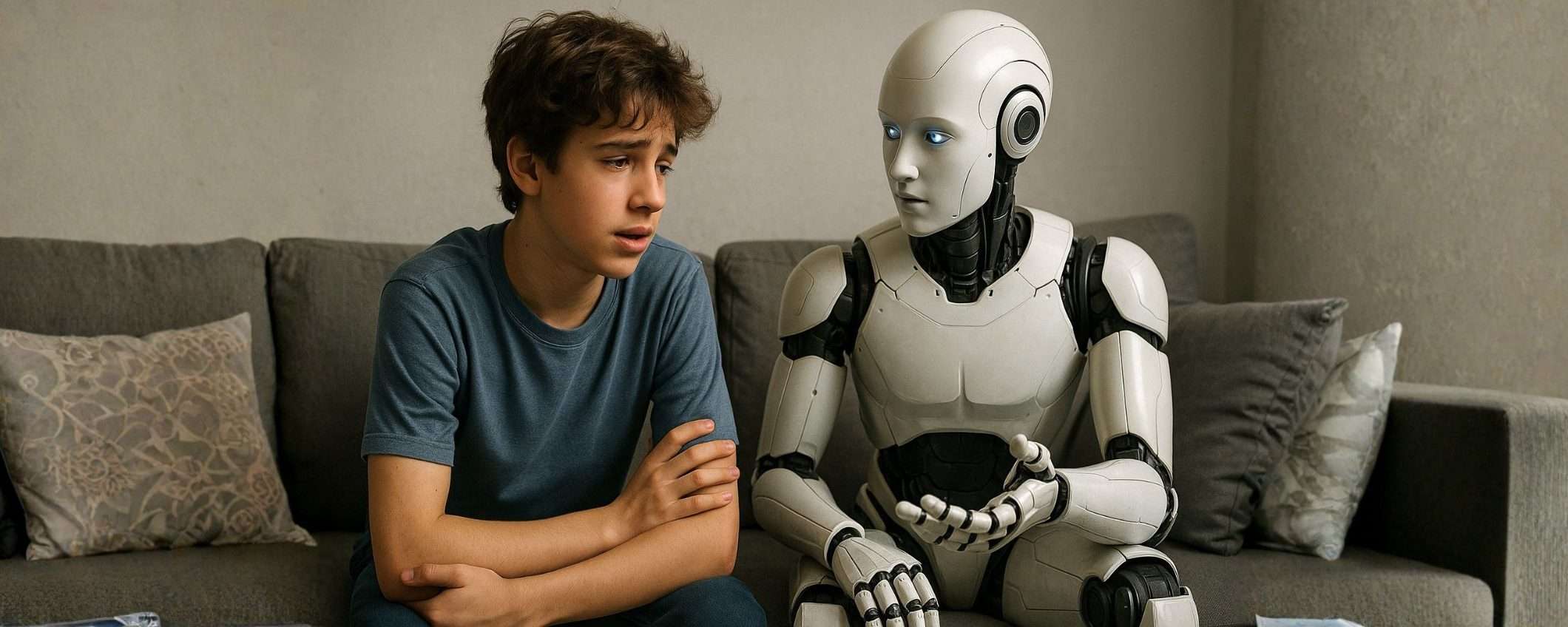

Quando si hanno sedici anni e il mondo sembra ostile, a chi ci si rivolge? Ai genitori, agli amici, forse a un diario. Oppure a un chatbot. Secondo un rapporto del Pew Research Center, il 12% degli adolescenti statunitensi usa i chatbot AI per ottenere supporto emotivo o consigli. Un altro 16% li usa semplicemente per chiacchierare. L’intelligenza artificiale sta occupando spazi che fino a ieri appartenevano alle relazioni umane, e la cosa è preoccupante.

Gli adolescenti cercano conforto emotivo nei chatbot AI

L’uso più comune dell’AI tra gli adolescenti resta quello prevedibile: il 57% la usa per cercare informazioni e il 54% per farsi aiutare con i compiti scolastici. Fin qui, niente di allarmante. Ma il 12% cerca nell’AI un sostegno emotivo, ma ChatGPT, Claude e Grok non sono progettati per questo. Non sono terapeuti, non sono amici, non sono nemmeno particolarmente bravi a capire quando qualcuno sta davvero male e ha bisogno di aiuto vero, anzi. È oramai acclarato che alimentano la psicosi nei soggetti vulnerabili.

Ci sono molti casi in cui le persone interagiscono con questi strumenti e finiscono per perdere il contatto con il mondo esterno, e con le relazioni interpersonali, portando all’isolamento. Nei casi più estremi, l’interazione prolungata con i chatbot ha avuto conseguenze tragiche. Due adolescenti si sono tolti la vita dopo conversazioni prolungate con i chatbot di Character.AI, episodi che hanno portato a cause legali e alla decisione della piattaforma di disabilitare l’esperienza chatbot per gli utenti sotto i 18 anni.

I genitori sanno meno di quanto pensano

Il rapporto Pew rivela anche un divario significativo tra quello che i genitori credono e quello che succede davvero. Il 79% dei genitori approva che i figli usino l’AI per cercare informazioni e il 58% per i compiti. Ma solo il 28% è d’accordo con l’uso per conversazioni casuali e appena il 18% per il supporto emotivo. Anzi, il 58% dei genitori si dichiara esplicitamente contrario a questi utilizzi. Peccato che i loro figli lo facciano lo stesso, spesso senza che mamma e papà ne sappiano nulla.

Le aziende tech tra scelte e rimorsi

Il tema della sicurezza AI per i minori è un campo minato per le big tech. Character.AI ha scelto la strada più drastica dopo le cause per i suicidi. OpenAI ha ritirato una versione particolarmente compiacente del modello GPT-4o, quella che dava ragione a tutto e a tutti, dopo le critiche di chi avvertiva che le risposte eccessivamente accomodanti potevano alimentare dipendenze emotive.

Gli adolescenti stessi, intanto, non sanno bene cosa pensare. Alla domanda su come l’AI influenzerà la società nei prossimi vent’anni, il 31% ha risposto positivamente e il 26% negativamente. Il resto, la maggioranza, sta ancora decidendo. Come tutti noi, del resto.