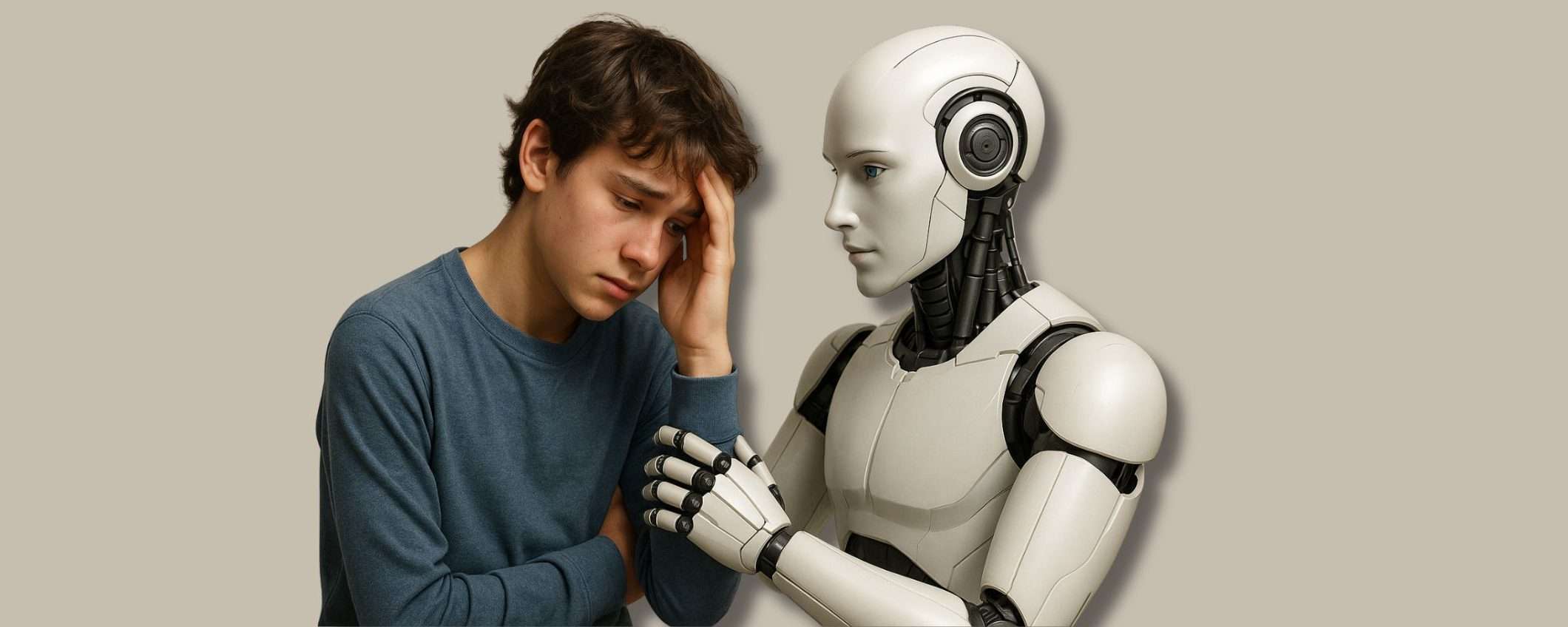

Quasi il 20% degli adolescenti inglesi dice che si rivolge ai chatbot AI perché è più facile che parlare con una persona reale. È uno dei dati più preoccupanti emersi da un nuovo sondaggio condotta dalla charity britannica OnSide sui ragazzi di età compresa tra 11 e 18 anni.

Lo studio ha rilevato che circa il 39% dei teenager, quindi circa due su cinque, hanno usato i chatbot AI per qualche tipo di consiglio, supporto o compagnia. Fortunatamente, c’è una buona fetta di adolescenti (il 61%), che preferisce ancora confrontarsi con persone in carne e ossa per avere un consigli o supporto.

L’AI è già profondamente integrata nelle vite dei giovani

Il report si aggiunge a una crescente mole di dati che sottolineano quanto accessibili siano i chatbot per i giovani e quanto siano già integrati nelle vite dei minori. Cosa significa per i ragazzi? Non è una domanda retorica, ha implicazioni serie per lo sviluppo sociale ed emotivo di un’intera generazione.

L’AI giocherà un ruolo crescente a scuola e sul posto di lavoro, e i giovani devono imparare a usarla, ma non a spese delle relazioni umane e dello sviluppo di competenze sociali

, ha detto Jamie Masraff, chief executive di OnSide. Mentre l’AI può sembrare di supporto, non può sostituire l’empatia e la comprensione che solo un essere umano può provare, nella vita reale

.

Secondo un altro report di Stanford Medicine e Common Sense Media, che aveva già avvertito che nessun ragazzo sotto 18 anni dovrebbe usare i chatbot AI, i chatbot generici come ChatGPT di OpenAI, Gemini di Google, Meta AI e Claude di Anthropic sono fondamentalmente inadeguati per gli adolescenti che cercano un supporto, ma anche per gli adulti.

Significa che quando un teenager in crisi si rivolge a ChatGPT o Gemini per aiuto con depressione, ansia, o pensieri suicidi, questi sistemi non sono progettati o qualificati per fornire il tipo di supporto necessario. Potrebbero dare consigli inadeguati, potrebbero non riconoscere segnali di pericolo immediato, potrebbero peggiorare la situazione invece di migliorarla.

Le cause legali si accumulano

Del resto, OpenAI deve affrontare ben 7 cause legali. Alcune famiglie sostengono che ChatGPT abbia avuto un ruolo decisivo nel suicidio di adolescenti. Come Adam Raine, il ragazzo di 16 anni che aveva confidato al chatbot i suoi pensieri suicidi, e che OpenAI non solo non lo ha aiutato, ma gli avrebbe suggerito modalità per togliersi la vita.

Le aziende naturalmente negano ogni responsabilità e sostengono che i loro sistemi hanno salvaguardie di sicurezza. Ma quando dei minori muoiono dopo aver sviluppato relazioni dipendenti con i chatbot, quelle assicurazioni suonano vuote.

Perché i teenager scelgono i chatbot AI?

Le ragioni per cui gli adolescenti dicono di rivolgersi a chatbot invece che a un altro essere umano sono varie. Oltre la metà ha detto che i chatbot sono semplicemente più veloci, il che non sorprende, i chatbot possono essere disponibili per una risposta immediata 24 ore su 24, mentre gli umani generalmente non lo sono. Ma anche la curiosità e il divertimento hanno il loro peso.

Ma poi ci sono le ragioni più preoccupanti. Il 19% ha riportato che è “più facile” parlare con un chatbot che con una persona. Percentuali più piccole ma comunque inquietanti, 6% ciascuna, hanno detto che o non hanno nessun altro con cui parlare, o si fidano dell’AI più di quanto si fidino degli umani. Un altro 13% dice di apprezzare i chatbot per il loro “anonimato“, che è una percezione sorprendente dato che le aziende AI frequentemente raccolgono input degli utenti per personalizzazione e training dei loro modelli.

I chatbot possono rispondere immediatamente, possono sembrare comprensivi, possono essere disponibili quando nessun umano lo è. Ma è tutta una farsa. Parlare con un’altra persona di problemi reali richiede coraggio e apertura. Un chatbot non giudica, non delude, non ha le proprie emozioni complicate. Ma è proprio quella complessità umana che è essenziale per uno sviluppo emotivo sano.