TikTok, l’app-social network in forte ascesa capace di attrarre a sé dai più giovani agli esponenti della politica nostrana, si trova oggi di nuovo al centro di una delicata questione: al team che ne gestisce la community può essere attribuito un comportamento etichettabile come discriminazione?

TikTok: quella linea sottile tra moderazione e discriminazione

Tutto nasce dalla diffusione di alcuni documenti che descrivono come ByteDance, società cinese che controlla la piattaforma, stia cercando di “proteggere” quelli che ritiene i membri più vulnerabili della propria base utenti: le persone con disabilità, quelle ascrivibili alla categoria queer e i ragazzi con problemi di peso. Queste le categorie descritte come speciali sulle quali i moderatori sono chiamati a intervenire affinché i loro post raggiungano un pubblico limitato.

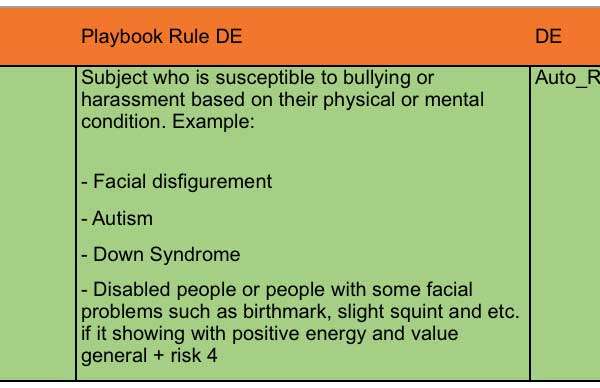

Quale la motivazione dietro una simile pratica? La posizione ufficiale è quella che fa riferimento alla volontà di tutelare i diretti interessati dal bullismo. Nel materiale ottenuto dal sito Netzpolitik si citano “Immagini raffiguranti un soggetto altamente vulnerabile al cyberbullismo” o “suscettibili di molestie o cyberbullismo in base alle loro condizioni fisiche o mentali”. A ogni utente viene attribuito un livello di rischio: nel caso della disabilità, ad esempio, è pari a 4 (immaginiamo su una scala da 1 a 5). Nelle linee guida consegnate ai moderatori anche la direttiva di applicare le restrizioni in caso di “deturpazione facciale”, “autismo” e “sindrome di Down”.

Ai contenuti in questione viene impedito di raggiungere un pubblico ampio: la comparsa nei feed degli altri iscritti viene bloccata dopo aver raggiunto 6.000 o 10.000 riproduzioni, a seconda del tag applicato.

Come scritto in apertura, dal canto suo TikTok si difende affermando che l’intenzione è quella di tutelare i membri più vulnerabili della propria community. C’è però anzitutto da chiedersi in che modo un moderatore possa riconoscere un disordine neuropsichico da un filmato di pochi secondi girato con lo smartphone.

Una mossa di questo tipo ha tutta l’aria di una misura preventiva attuata al fine di eliminare un problema (quello del bullismo) alla radice così da non dover poi eventualmente dover fare i conti con le sue conseguenze. Una questione con la quale altri social network si sono dovuti confrontare. Non ci sono scappatoie né scorciatoie: l’azione di bulli e hater va contrastata in modo fermo, ma attivamente (e non affidandosi solo agli automatismi di algoritmi o IA), non partendo dal presupposto che la possibilità di una loro manifestazione debba giustificare una penalizzazione di chi può essere identificato come una loro potenziale vittima.

La strada intrapresa da TikTok ci sembra la via più breve per affrontare una dinamica delicata, ma anche la più sbagliata per una piattaforma globale dai ritmi di crescita vertiginosi come quella di ByteDance che potrebbe e dovrebbe invece fare dell’inclusione e della diversità valori aggiunti, non un fardello da mettere in ombra. La linea che distingue protezione e discriminazione è molto sottile.