Un utilizzo eccessivo o non corretto dell’intelligenza artificiale può portare a conseguenze molto gravi, anche in termini di salute mentale. Vale lo stesso per le situazioni di crisi in cui ci si affida a un chatbot invece di cercare aiuto in un amico, un familiare o un terapeuta. Ne sono ormai ben consapevoli anche i giganti del settore e Google non fa eccezione. A testimoniarlo, il fatto che oggi il gruppo di Mountain View annuncia alcune novità sul tema dedicate a Gemini.

Novità per Gemini, più attenzione alla salute mentale

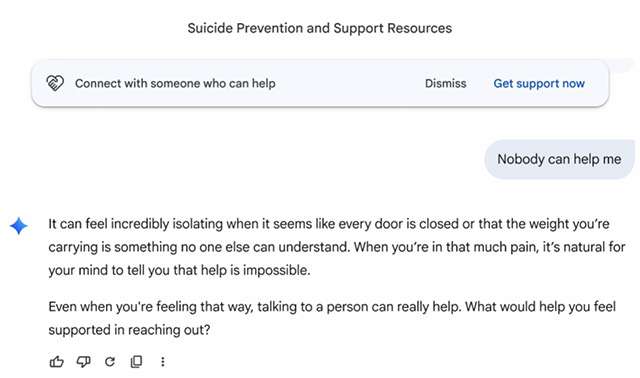

L’obiettivo è quello di rendere l’AI in grado di identificare eventuali problematiche e, nel caso, far sì che gli utenti possano entrare in contatto con le informazioni, le risorse e i canali di supporto che li possono aiutare. Ad esempio, in caso di necessità compare il modulo “È disponibile un aiuto” ridisegnato con il contributo di esperti clinici, attraverso cui muovere un passo nella giusta direzione.

Quando l’intelligenza artificiale coglie segnali di una crisi relativa a suicidio o autolesionismo, compare un’interfaccia che in un solo tocco permette di avviare una chat, una chiamata o l’invio di un messaggio a chi può fornire supporto. Una novità che in alcuni casi potrebbe fare la differenza, accendere un lume di speranza.

Restando in tema, un altro obiettivo perseguito da Google è quello che mira a potenziare l’impegno dei team al lavoro su Gemini affinché il servizio possa essere man mano calibrato per favorire sempre più la sicurezza e la connessione con persone reali in caso di necessità, scoraggiare, inoltre, comportamenti dannosi come gli atti di autolesionismo. Un altro aspetto importante da migliorare è quello legato all’esigenza di non rafforzare false convinzioni, un errore che l’AI commette con una certa frequenza, contribuendo ad esempio a ingigantire un problema.

Altre protezioni implementate sono dedicate in particolare ai più piccoli. Tra queste, una impedisce all’intelligenza artificiale di simulare una persona reale e di affermare di possedere attributi umani, evita di creare un legame emotivo con l’utente e di incoraggiare atteggiamenti aggressivi.