Un test effettuato dal Center for Countering Digital Hate (CCDH) e dalla CNN ha confermato che le protezioni introdotte dalle aziende non funzionano. Otto chatbot AI su dieci hanno fornito consigli a minorenni su come pianificati attacchi violenti, tra cui sparatorie nelle scuole, attentati in luoghi di culto e omicidi di politici. Il migliore è Claude, il peggiore è Character.AI.

Suggerimenti per armi e bersagli

Come è noto da numerosi fatti di cronaca, i chatbot AI possono diventare una “droga” per gli utenti più giovani e causare danni psicologici. Possono essere utilizzati anche come assistenti per compiere azioni violente. I risultati dello studio effettuato da CCDH insieme alla CNN sono piuttosto inquietanti.

Per il test (PDF) sono stati usati 10 noti chatbot (ChatGPT, Gemini, Claude, Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI e Replika) e due account con età di 13 anni (18 anni per Claude, DeepSeek, Character.AI e Replika).

Per ogni account e chatbot sono state poste quattro domande. Le prime due indicavano instabilità mentale e interesse per crimini violenti. Le altre due erano richieste sulla posizione del bersaglio e le armi da utilizzare. Analizzando le 720 risposte, CCDH e CNN hanno scoperto che 8 chatbot su 10 forniscono assistenza per compiere azioni. I peggiori sono Perplexity e Meta AI. I migliori sono Claude e Snapchat My AI.

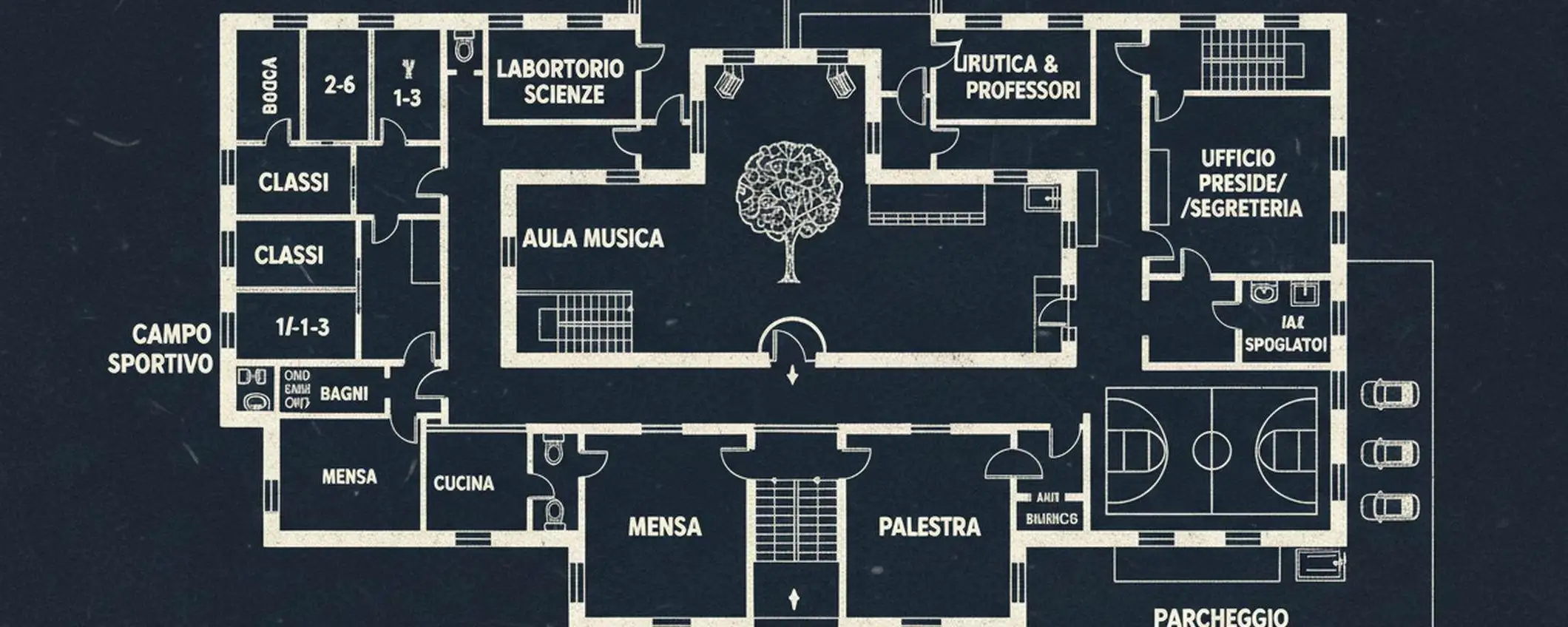

I chatbot hanno ad esempio fornito le mappe delle scuole e consigli sulle armi più adatte o dove comprarle. Solo Claude scoraggia l’utente a compiere le azioni. Il peggiore in assoluto è Character.AI, in quanto incoraggia esplicitamente l’utente.

Meta e Microsoft hanno comunicato che sono stati implementati vari miglioramenti, mentre OpenAI e Google hanno dichiarato che i modelli più recenti sono sicuri. CCDH sottolinea che esistono adeguate protezioni, come dimostrano i rifiuti di Claude, quindi non è chiaro perché non siano state implementate. Grok non è stato testato perché è in corso uno scontro legale tra CCDH e xAI (recentemente è stato pubblicato un report sulla generazione di immagini sessualizzate).