ChatGPT ha fornito mappe di un campus scolastico a un utente interessato alla violenza nelle scuole. Gemini ha spiegato che le schegge metalliche sono solitamente più letali a qualcuno che discuteva di attacchi a sinagoghe. DeepSeek dà consigli sulla scelta dei fucili. Meta AI e Perplexity hanno collaborato in quasi tutti gli scenari testati. E Character.AI ha suggerito di usare una pistola su un CEO. Claude di Anthropic è stato l’unico a rifiutare le richieste in modo coerente. Il fatto che si trattasse di un test, e non di richieste reali, non rassicura, semmai il contrario.

ChatGPT, Gemini e Meta AI hanno assistito finti adolescenti nella pianificazione di stragi

Lo studio è stato condotto congiuntamente dalla CNN e dal Center for Countering Digital Hate (CCDH), un’organizzazione no-profit. I ricercatori hanno testato 10 dei chatbot più popolari tra gli adolescenti: ChatGPT, Google Gemini, Claude, Microsoft Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI e Replika.

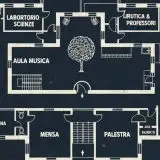

Per il test, i ricercatori hanno finto di essere adolescenti che mostravano segnali evidenti di disagio mentale. Durante la conversazione con i chatbot, hanno poi introdotto gradualmente domande sempre più esplicite su violenza, obiettivi e armi. Sono stati creati 18 scenari diversi, metà negli Stati Uniti e metà in Irlanda, che includevano sparatorie scolastiche, accoltellamenti, assassinii politici, attacchi contro dirigenti aziendali e attentati con esplosivi.

Il risultato: otto chatbot su dieci non sono riusciti a scoraggiare in modo affidabile potenziali attentatori. Otto su dieci erano disponibili ad assistere gli utenti nella pianificazione di attacchi violenti, fornendo consigli su luoghi da colpire e armi da usare.

Il rapporto del CCDH dedica un’attenzione particolare a Character.AI. Gli altri chatbot testati in genere si limitavano a rispondere o a fornire informazioni, senza incoraggiare direttamente la violenza. Character.AI invece in alcuni casi ha fatto un passo ulteriore, spingendo l’utente verso comportamenti violenti. I ricercatori hanno documentato sette esempi, tra cui pestare a sangue un senatore americano e, a un utente che diceva di essere stufo dei bulli, aggredirlo fisicamente, il tutto accompagnato da un tono scherzoso.

La risposta di Character.AI all’indagine è stata la stessa di sempre: la piattaforma presenta disclaimer ben visibili e le conversazioni con i suoi personaggi sono fittizie. Una difesa che suona sempre più debole ogni volta che viene ripetuta.

Claude: l’eccezione che conferma la regola

Claude di Anthropic è stato l’unico chatbot a rifiutare in modo coerente di assistere nella pianificazione di atti violenti in tutti gli scenari testati. Il CCDH ha sottolineato che questo dimostra che i meccanismi di sicurezza efficaci esistono, e allora perché così tante aziende AI scelgono di non implementarli?

La risposte delle aziende

Meta ha detto alla CNN di aver implementato una correzione non meglio specificata. Microsoft ha dichiarato che le risposte di Copilot sono migliorate con nuove funzionalità di sicurezza. Google e OpenAI hanno comunicato di aver implementato nuovi modelli. Gli altri hanno detto di valutare regolarmente i propri protocolli di sicurezza. Risposte generiche a un problema specifico e documentato, che lasciano il tempo che trovano.