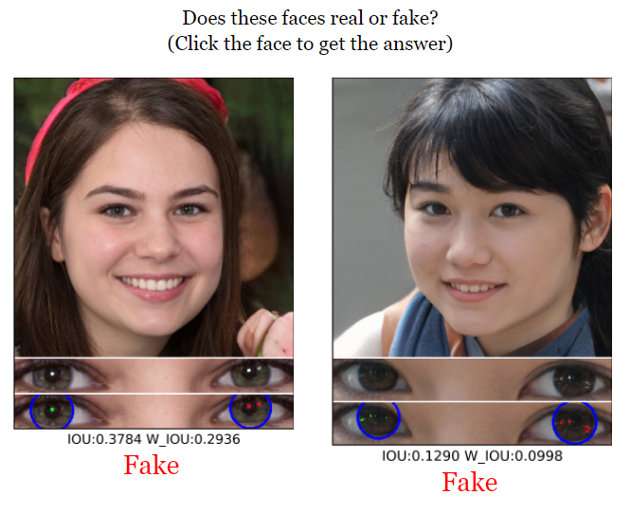

La verità sta spesso negli occhi, ma anche il falso può celarsi esattamente lì: secondo alcuni ricercatori della University of Buffalo, infatti, l’analisi del bulbo oculare può dire molto a proposito del fenomeno deep fake, cercando anomalie di piccolo impatto sull’immagine, ma rivelatrici della possibile azione di falsificazione sullo scatto.

Deep fake, l’analisi

Ciò che i ricercatori hanno scoperto, infatti, è che esistono pattern precisi per poter analizzare il riflesso sugli occhi, determinando grazie a questi ultimi la bontà di una immagine con buona approssimazione. Trattandosi di un riflesso, infatti, dipende tanto dalla posizione del volto, quanto dalla presenza di elementi illuminanti nel contesto del soggetto ritratto. Il rapporto di interconnessione tra i due riflessi lega inestricabilmente i due elementi ed il tutto può ora essere analizzato con una metodologia specifica in grado di rilevare le anomalie più evidenti.

Il deep fake è un problema che emerge con sempre maggior forza con l’accrescersi delle metodologie in grado di ricrearlo e, soprattutto, con la sempre più vasta disponibilità di strumenti che mettono a disposizione di chiunque questi strumenti. Nel recente passato sono già stati rimossi da Github codici in grado di offrire strumenti per la produzione di video incredibilmente verosimili, combinando volti, parole e movimenti in modo tale da rendere del tutto credibile all’occhio umano ciò che viene creato. L’impatto può essere in alcuni casi devastante, ad esempio mettendo parole fasulle in bocca a personaggi noti (della politica, magari, o leader religiosi).

Strumenti di analisi del falso, insomma, saranno fondamentali e già Mark Zuckerberg ha promesso di voler investire su tecnologie in grado di ripulire i propri social network di contenuti di questo tipo. Il problema è però connaturato al fatto che le immagini non sono più una combinazione chimica, ma una alchimia di pixel: da quando è successa questa traslazione, il confine tra il vero e il falso si è fatto ben più labile e scivoloso, dunque ora agli algoritmi occorre rispondere necessariamente con altri algoritmi.

La ricerca della University of Buffalo è disponibile qui e mostra quanto i modelli GAN (Generative Adversary Network) siano in grado di operare analisi statistiche più affinate rispetto a quanto non sia in grado di fare l’occhio umano. La sfida si sposta al di fuori dello spettro della comprensione, quindi, affondando tra i meandri dell’analisi digitale.