Partiamo col dire che l’obiettivo di semplificare i nomi dei modelli non è stato centrato. GPT‑5.3‑Codex‑Spark è l’ultima new entry della famiglia OpenAI, appena annunciato. Così come il fratello maggiore (GPT-5.3-Codex) svelato una settimana fa è addestrato in modo specifico per la programmazione, ma con una differenza fondamentale: ne rappresenta una versione ridotta, concepita per una rapidità più elevata.

GPT‑5.3‑Codex‑Spark, AI ultraveloce per il coding

È il primo frutto della collaborazione che dal mese scorso lega l’organizzazione di Sam Altman a Cerebras, finalizzata ad accelerare i lunghi output dei modelli di AI

. Basato sul Wafer Scale Engine 3, in un primo momento è disponibile solo attraverso una distribuzione graduale per gli utenti con abbonamento Pro a ChatGPT. L’accesso è inoltre consentito via API a un numero limitato di partner.

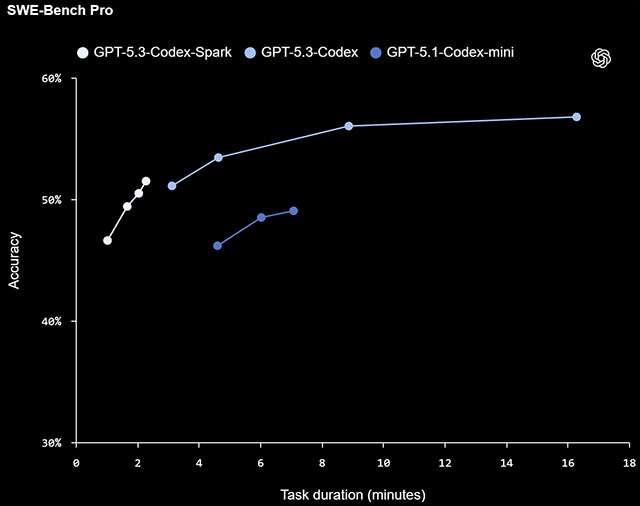

Il grafico qui sopra spiega in modo chiaro quali sono le prestazioni di GPT‑5.3‑Codex‑Spark, valutate con SWE-Bench Pro: si posiziona a metà strada tra GPT-5.1-Codex-Mini e il nuovo GPT-5.3-Codex, ma riuscendo a portare a termine l’attività in un tempo molto ridotto. Ecco perché OpenAI lo presenta come un modello di intelligenza artificiale confezionato per la collaborazione in tempo reale, un contesto in cui è necessario ridurre la latenza e le attese al minimo. Una visione ben sintetizzata in questo passaggio dell’annuncio.

Man mano che i modelli diventano più performanti, la velocità di interazione diventa un chiaro collo di bottiglia. L’inferenza ultraveloce riduce questo problema, rendendo Codex più naturale da usare e ampliando le possibilità di chiunque voglia trasformare un’idea in un software funzionante.

La velocità è uno degli aspetti che gli utenti terranno sempre più in considerazione scegliendo a quale servizio o tecnologia affidarsi. E la programmazione è una delle attività che maggiormente stanno cambiando con l’adozione massiva dell’AI. L’azienda di ChatGPT e Codex lo sa bene e punta in questa direzione per non perdere terreno nei confronti della concorrenza che di certo non rimarrà a guardare. Cosa poi si sceglie di fare nel tempo risparmiato è un altro discorso.