Gli esperti concordano sul fatto che un utilizzo eccessivo dell’intelligenza artificiale fa male al cervello. Con questa doverosa (e inquietante) premessa, segnaliamo l’arrivo di un assistente AI che promette di evitarlo: si chiama Lucid. Sviluppato da TetiAI, è il frutto di un progetto open source messo in campo con l’obiettivo di preservare il pensiero critico degli utenti.

Come funziona la protezione cognitiva di Lucid

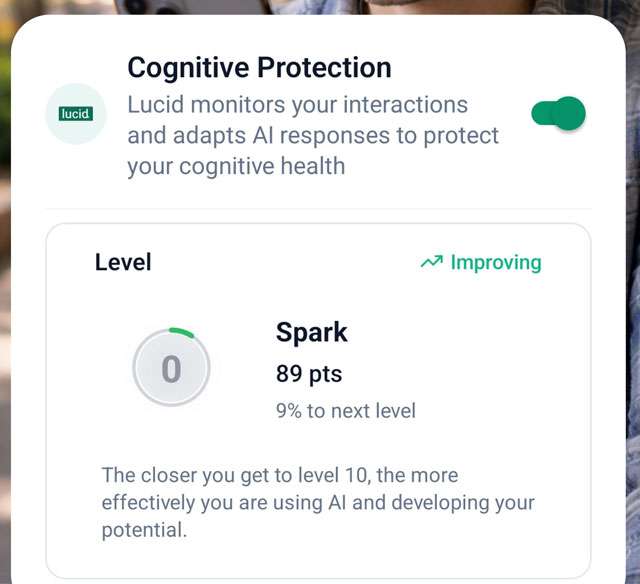

Abbiamo ricevuto in redazione il comunicato che ne annuncia il lancio. È già integrato nell’app Teti (Android, iOS) e caratterizzato da una funzionalità di protezione cognitiva che si occupa di adattare in tempo reale le risposte sulla base delle interazioni generate.

Non limita l’uso dell’AI, ma adatta il suo comportamento sulla base di sei parametri osservati: livello di autonomia nel ragionamento, profondità della comprensione, grado di coinvolgimento, consapevolezza del proprio pensiero, capacità di verificare le informazioni e motivazione. Ad esempio, chi ha la tendenza a delegare tutto viene stimolato con domande mirate, chi dimostra autonomia riceve sfide più complesse, mentre se si manifestano segnali di affaticamento scatta l’invito a fare una pausa.

Non sappiamo quanto un approccio responsabile e calibrato di questo tipo possa trovare spazio in un ambito come quello dell’intelligenza artificiale, dove tutto e subito sembrano oggi due priorità assolute e irrinunciabili. Di certo è interessante, soprattutto considerando gli effetti potenzialmente negativi che l’uso eccessivo e senza protezioni dei chatbot può avere sulle capacità cognitive dei più giovani, durante il periodo della crescita e della formazione. Questa la visione di TetiAI.

La protezione cognitiva dovrebbe diventare uno standard universale, come le cinture di sicurezza nelle automobili. Il rischio non è nella singola interazione, ma nell’effetto cumulativo di migliaia di interazioni nel tempo.

Una presa di posizione più che condivisibile, ma forse utopica. Considerando come si stanno muovendo i big del settore, la presenza pervasiva di modelli e algoritmi, fatichiamo a immaginare che realtà come OpenAI, Google o Anthropic possano rivedere le loro strategie nel nome della nostra salute mentale. Maggiori informazioni nel repository GitHub dedicato.