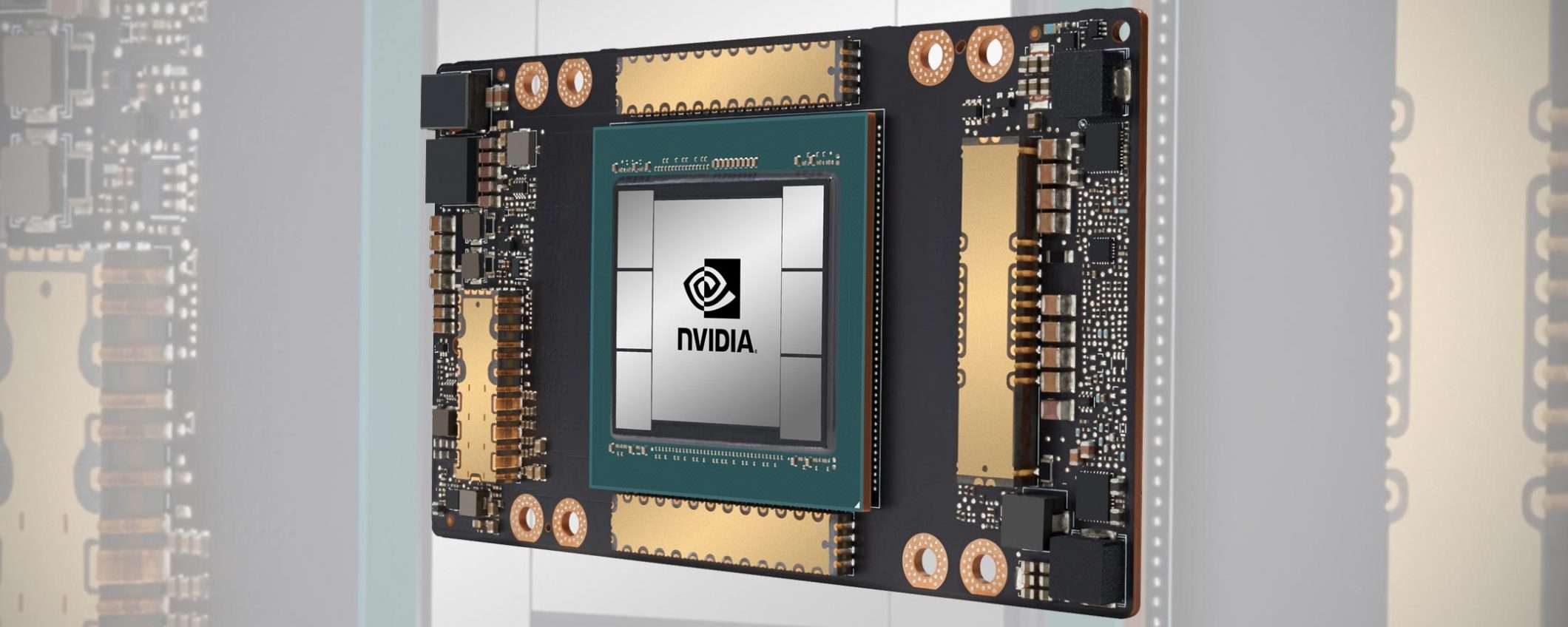

Giunge oggi da NVIDIA l’annuncio della nuova architettura Ampere destinata alle GPU: il primo modello a integrarla è A100, una scheda non destinata all’ambito consumer per il gaming o l’elaborazione dei contenuti multimediali, ma ai server dei data center e alle macchine impiegate per ambiti come la ricerca scientifica o l’analisi dei Big Data.

NVIDIA A100, la prima GPU con architettura Ampere

Realizzata dal chipmaker di Santa Clara con processo produttivo a 7 nm, al suo interno trovano posto oltre 54 miliardi di transistor. I core integrati offrono una potenza di calcolo che arriva a 19,5 teraFLOPS (FP32), 6.912 CUDA core, 40 GB di memoria dedicata e bandwith che arriva a 1,6 TB/s. Questo il commento del CEO Jen-Hsun Huang.

È sostanzialmente vicina ai limiti teorici di quanto è possibile fare oggi nell’industria dei semiconduttori. Si tratta del più grande processore mai realizzato al mondo con il più elevato numero di transistore in un engine per il computing.

Come già detto l’architettura Ampere e la GPU annunciata oggi non troveranno posto nei PC destinati al mercato, almeno non in un primo momento. Faranno parte dell’offerta rivolta da NVIDIA a chi gestisce le infrastrutture cloud e i data center, come accaduto in passato con l’architettura Volta: ad esempio otto A100 lavoreranno insieme grazie alla tecnologia NVLink all’interno del sistema DGX A100 per l’IA, come una sola componente hardware con prestazioni da 5 petaFLOPS. Alcune unità sono già operative presso lo US Argonne National Laboratory con finalità legate alla ricerca scientifica su COVID-19.

L’annuncio odierno è legato a doppio filo alla recente acquisizione di Mellanox, portata a termine da NVIDIA con un investimento pari a 6,9 miliardi di dollari. L’azienda, specializzata nella fornitura delle componenti per i data center: Huang definisce le sue competenze e la sua esperienza come il “tessuto connettivo” per la prossima generazione delle infrastrutture cloud.