La richiesta di un semplice consiglio ad Alexa su come pulire la lavatrice si è trasformato in queste ore in un vero e proprio caso, riaccendendo il dibattito sull’affidabilità degli assistenti digitali basati sull’AI. L’episodio è rimbalzato online dopo essere stato condiviso da un utente sulla piattaforma Reddit, nella sezione dedicata all’assistente Amazon. L’errore compiuto da Alexa sarebbe stato quello di elencare una serie di prodotti che se mescolati possono rivelarsi dannosi per la salute.

L’equivoco sta tutto nella differenza tra “e” e “oppure”

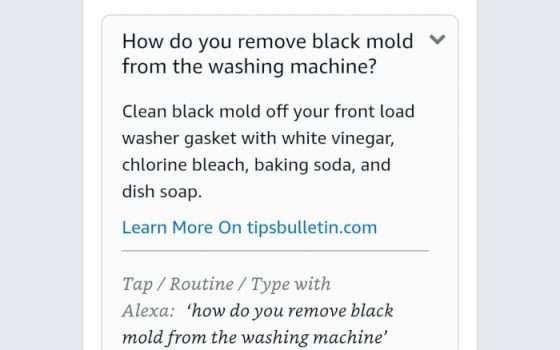

Dopo aver chiesto ad Alexa come rimuovere la muffa nera dalla guarnizione della sua lavatrice a carica frontale, l’utente ha ricevuto un elenco di prodotti tutto sommato efficaci per risolvere il problema. L’assistente ha indicato in ordine: aceto bianco, candeggina, bicarbonato di sodio e detersivo per i piatti. Come riportato da Tech Issues Today, la fonte consultata da Alexa è stato il sito TipsBulletin.com, portale che raccoglie guide e suggerimenti per la pulizia.

Insomma, tutto lascerebbe pensare ad un normale elenco di prodotti comunemente utilizzati per le pulizie domestiche. Tuttavia il problema si nasconde in un dettaglio linguistico: la formulazione della frase. L’uso della congiunzione “e” tra i vari ingredienti può essere interpretato come un invito a combinarli tra loro, cosa che può risultare altamente pericolosa.

Mescolare, infatti, candeggina e aceto è estremamente pericoloso per la salute. L’unione tra le due sostanze produce cloro gassoso, un gas tossico e irritante che causa difficoltà respiratorie, tosse, bruciore agli occhi, lacrimazione e vertigini. Il rischio è più amplificato nei luoghi chiusi. Inoltre, se inalato in grandi quantità il cloro gassoso può portare danni polmonari gravi o addirittura il decesso.

Eppure le informazioni contenute sul sito consultato da Alexa sono chiare e corrette. L’errore commesso dall’assistente, quindi, è stato quello di aver unito più metodi in un’unica frase omettendo che si tratta di procedimenti distinti. Insomma, Alexa ha perso chiarezza nell’esporre le soluzioni inserendo una “e” congiunzione al posto di un “oppure”. Questo problema, che potrebbe sembrare innocuo, diventa serio quando una svista come quella appena descritta può comportare un problema alla salute.

Nel frattempo l’episodio è stato segnalato ad Amazon. Resta però aperto il tema sulle modalità con cui i sistemi di intelligenza artificiale devono presentare e sintetizzare le informazioni: anche una semplice sfumatura linguistica può difatti cambiare il significato di una risposta e generare interpretazioni potenzialmente rischiose.