Will Smith che divora spaghetti come se non mangiasse da giorni, Gordon Ramsay che dà fuoco alla cucina… Questi video ci hanno fatto ridere eccome, su TikTok, ma magari senza sapere che era tutta opera dell’intelligenza artificiale.

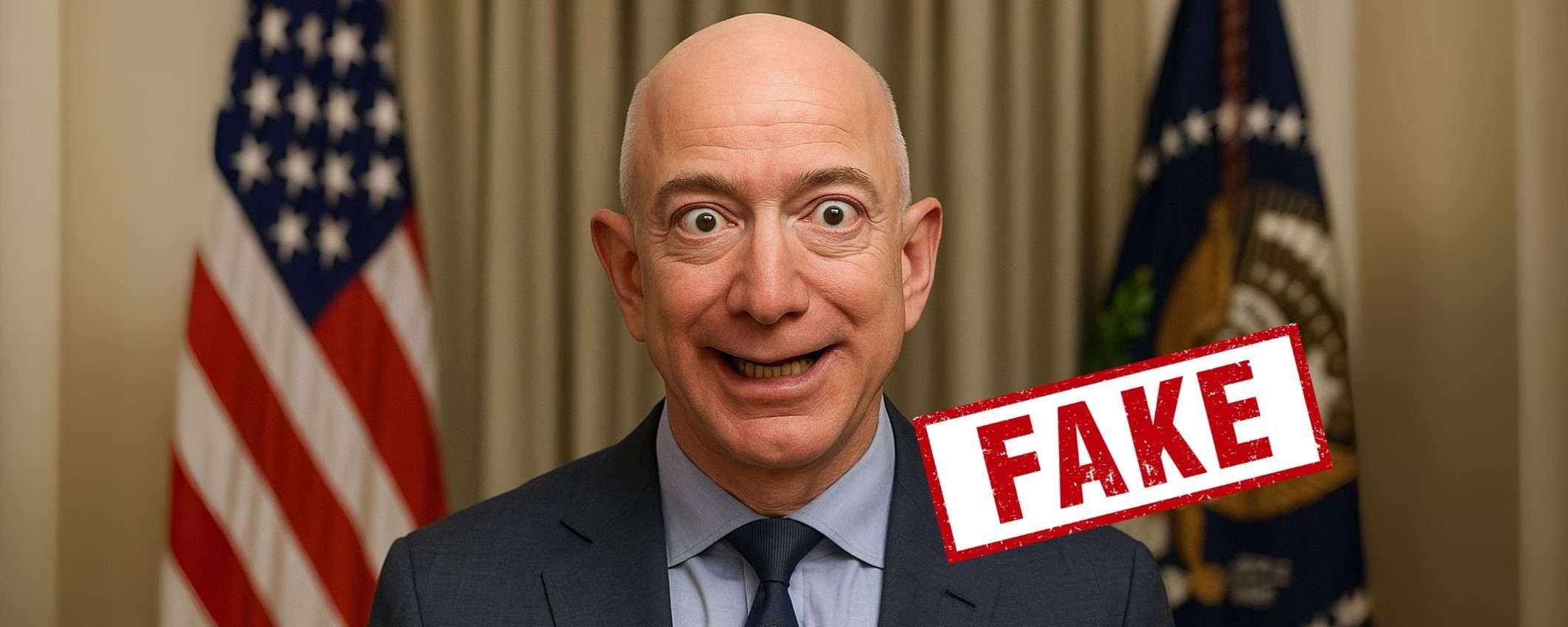

Viviamo in un’epoca in cui distinguere la realtà dalla finzione sta diventando un’impresa. L’AI può creare video così convincenti, che anche gli esperti a volte ci cascano. Ma per fortuna, le macchine non sono ancora perfette, e lasciano sempre qualche traccia.

Realtà o illusione? Come riconoscere i video deepfake

1. Quando le leggi della fisica non esistono più

Il primo campanello d’allarme è la violazione delle leggi fondamentali della fisica. Nell’universo reale, gli oggetti cadono verso il basso, i liquidi si comportano come liquidi, e nessuno può fare salti di 3 metri senza un aiuto. L’intelligenza artificiale, però, non ha mai studiato fisica al liceo…

Nei video deepfake è comune vedere persone che saltano con movimenti in stile Matrix, oggetti che cambiano direzione senza motivo apparente, o l’acqua che si comporta come plastilina. Questi errori nascono dal fatto che l’AI impara dai dati, non dalla comprensione reale di come funziona il mondo.

La cosa interessante è che questi “miracoli” della fisica non sono intenzionali come negli effetti speciali di un film. Sono semplicemente errori che l’algoritmo commette perché non sa distinguere tra ciò che è possibile e ciò che non lo è.

2. Transizioni che non hanno senso

È capitato sicuramente a tutti di vedere un video dove una persona si trasforma gradualmente in un’altra. Oppure, dove un oggetto diventa magicamente qualcos’altro. Sono le famose “morphing transitions” dei video AI.

L’intelligenza artificiale genera i video fotogramma per fotogramma. Il problema è che non ha una comprensione della narrazione che sta creando. Quando si riprende qualcosa con il telefono e poi si monta, anche il taglio più amatoriale mantiene una logica di base. L’AI invece può saltare da una scena all’altra senza criterio. Con i video lunghi, questi salti assurdi diventano evidenti, perché l’AI ha più opportunità di “perdere il filo” della storia che dovrebbe raccontare.

3. Il mistero delle espressioni umane

Gli esseri umani sono macchine incredibilmente sofisticate quando si tratta di leggere le emozioni altrui. Passiamo la vita a osservare i volti delle persone. Il nostro cervello è programmato per cogliere i cosiddetti “segnali non verbali”.

L’intelligenza artificiale, per quanto avanzata, tutta questa complessità se la sogna. I risultati sono volti che sembrano “quasi giusti” ma con qualcosa che non quadra. Può essere un battito di ciglia innaturale, un sorriso che appare e scompare troppo velocemente, o movimenti della bocca che non coincidono con le parole.

La disconnessione è ancora più evidente tra azioni ed emozioni. Se si vede qualcuno in una situazione di pericolo che sorride beatamente, o una persona che riceve una brutta notizia con un’espressione di gioia, probabilmente si sta guardando un prodotto dell’AI.

4. Lo sfondo tradisce (quasi) sempre

Spesso l’intelligenza artificiale si concentra sul soggetto principale del video, e trascura quello che succede sullo sfondo. È qui che si nascondono molti degli indizi più rivelatori. Negli sfondi dei video deepfake si possono trovare texture che superfici che tremano senza motivo, alberi che si muovono in modo innaturale, o elementi architettonici che non rispettano le regole della prospettiva. Sono quelli che gli esperti chiamano “artefatti visivi“, piccole imperfezioni che a un occhio attento non sfuggono.

Il motivo è semplice: chi usa l’AI per creare video si preoccupa principalmente che il soggetto principale sia convincente. Lo sfondo viene considerato secondario, ma proprio per questo diventa il punto debole dell’intera illusione.

5. Quando le emozioni non coincidono con la realtà

Una delle sfide più grandi per l’intelligenza artificiale è coordinare azioni ed emozioni in modo credibile. Mentre l’AI riesce bene a creare figure umane in senso generale, quando deve mostrare qualcuno che parla o esprime emozioni specifiche, iniziano i problemi.

Il risultato sono video dove si vedono persone che reagiscono in modo inappropriato alle situazioni. Una risata fragorosa durante un momento drammatico, un’espressione impassibile di fronte a una sorpresa, o semplicemente movimenti delle labbra che non corrispondono alle parole pronunciate. Questa disconnessione nasce dal fatto che l’AI apprende da enormi database di immagini e video, ma non ha una comprensione intrinseca del significato emotivo di quello che sta creando.

6. Le sequenze che non stanno né in cielo né in terra

Forse il segnale più lampante che si sta guardando un deepfake sono le cosiddette “sequenze nonsense“: narrazioni che non hanno alcuna logica interna. L’esempio più famoso è quello di Will Smith che mangia spaghetti in modo compulsivo e disordinato, un video che è diventato virale proprio per la sua assurdità. Oppure Gordon Ramsay che cucina in una sequenza surreale che sfida ogni logica.

Questi video nascono perché l’AI, tanto per essere chiari, non ha una comprensione reale di quello che sta creando. Genera immagini basandosi su pattern statistici, non su una logica di causa-effetto.

L’importanza dell’istinto

Oltre a tutti i segnali tecnici, esiste uno strumento che spesso sottovalutiamo: il nostro istinto. Gli esseri umani hanno sviluppato nel corso di millenni una capacità incredibile di percepire quando qualcosa “non torna”. Il problema è che viviamo in un’epoca di attenzione ridotta, dove molti contenuti vengono consumati velocemente senza alcuno spirito critico. Quindi per i deepfake, è una pacchia.

Il segreto è prestare attenzione a ciò che si guarda. Se qualcosa sembra troppo bello, troppo strano, o troppo perfetto per essere vero, forse non lo è.

L’intelligenza artificiale migliora giorno dopo giorno, alcuni di questi segnali potrebbero presto diventare obsoleti. Ma per ora, un occhio attento e un sano scetticismo rimangono i nostri migliori alleati per navigare in questo nuovo mondo, dove la finzione fa di tutto per prendere il posto della realtà.