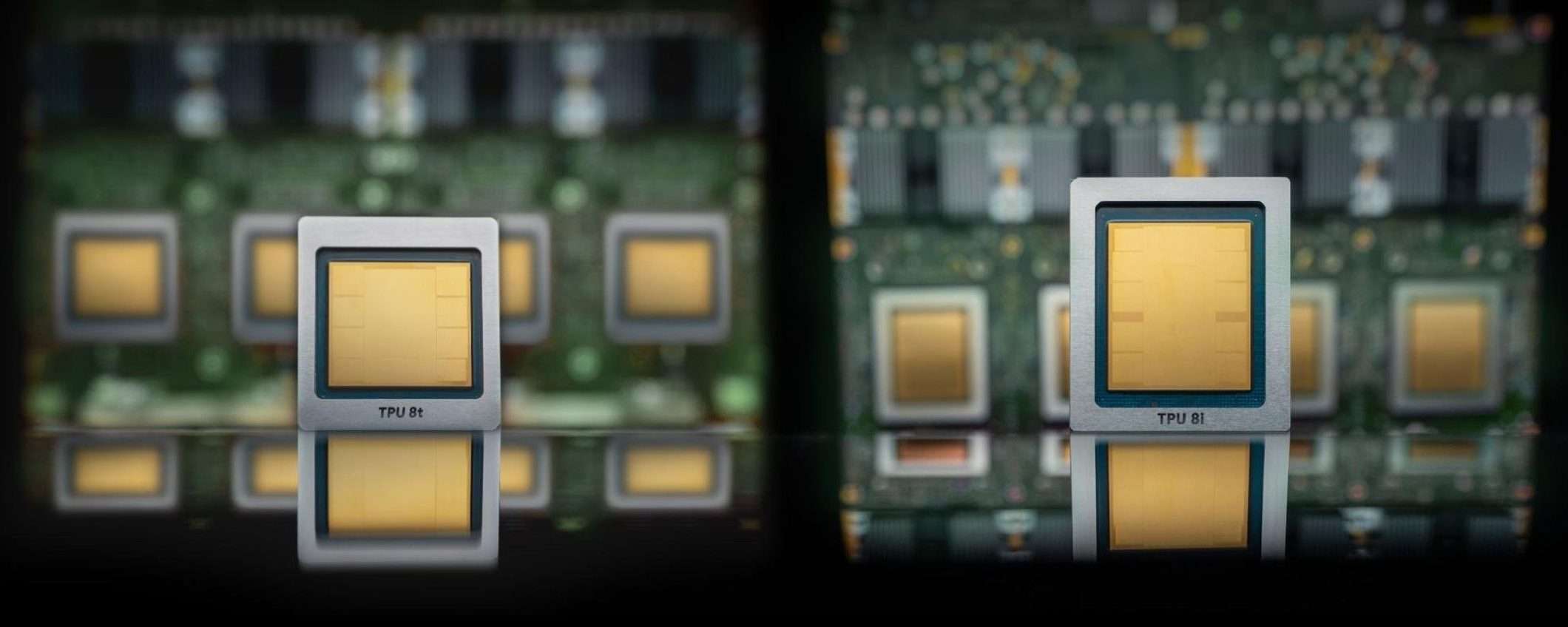

Durante l’evento Cloud Next, Google ha annunciato due nuovi chip AI in grado di offrire la potenza di calcolo richiesta di flussi di lavoro agentici. TPU 8t e TPU 8i sono Tensor Processing Unit di ottava generazione che verranno installati nei supercomputer usati per l’addestramento e l’inferenza del modelli AI, rispettivamente. Verranno ovviamente sfruttati per Gemini, oltre che da terze parti.

Principali caratteristiche delle nuove TPU

Google sottolinea che nell’era degli agenti AI è necessario elaborare complesse attività in parallelo. Ciò richiede infrastrutture in grado di gestire l’incremento dei flussi di lavoro. La risposta dell’azienda di Mountain View sono TPU 8t e TPU 8i. Dall’addestramento iniziale alla catena di ragionamento offrono elevate prestazioni abbinate a consumi inferiori rispetto alla precedente generazione (Ironwood).

TPU 8t è il chip dedicato all’addestramento dei modelli. È stato quindi progettato per offrire le massime prestazioni. Un singolo superpod può ospitare fino a 9.600 chip per un totale di 121 ExaFlops, ovvero circa quattro volte un superpod con chip Ironwood. La larghezza di banda interchip è raddoppiata passando da 9,6 a 19,2 Tb/s per chip. La larghezza di banda della rete è 400 Gb/s (quattro volte maggiore).

TPU 8i è invece il chip specializzato nell’inferenza dei modelli. In questo caso viene considerata la velocità di risposta alle query degli utenti. Per gestire efficacemente le richieste in parallelo degli agenti AI, ogni chip è abbinato a 288 GB di HBM (High Bandwidth Memory) e 384 MB di SRAM (il triplo rispetto alla precedente generazione). Un superpod può ospitare fino a 1.152 chip.

Google ha migliorato l’efficienza con una gestione integrata dell’alimentazione che regola dinamicamente il consumo energetico in base alla domanda in tempo reale. TPU 8t e TPU 8i offrono prestazioni per Watt fino a due volte superiori rispetto alla generazione precedente. I due chip saranno disponibili entro fine 2026.