Arriva dai laboratori della University of Cambridge la notizia di una tecnologia battezzata Predictive Touch, messa a punto in collaborazione con Jaguar Land Rover e quindi immaginiamo destinata in primis all’ambito automotive, ma che potrebbe tornare utile anche in altri contesti. Si tratta di fatto di un display touchscreen che non richiede di toccare la superficie per l’esecuzione dei comandi.

Il display touchscreen che non si tocca

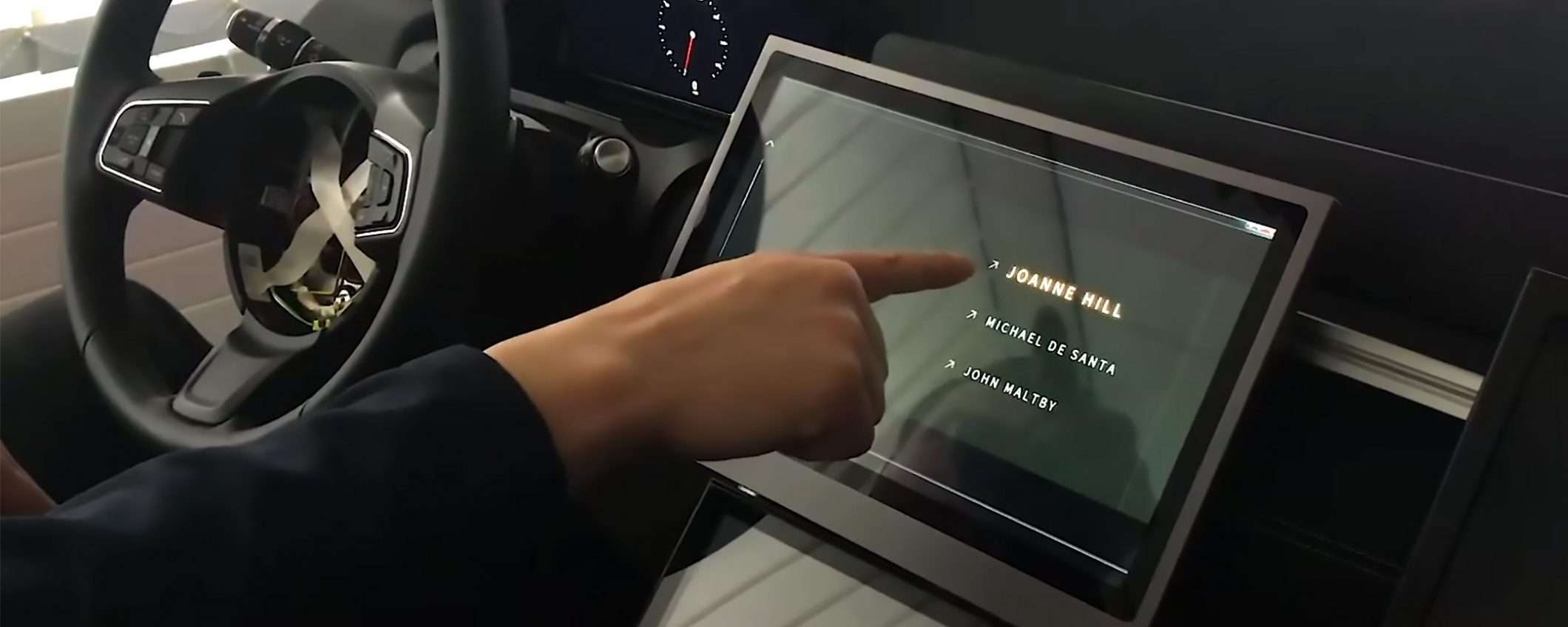

Un approccio touchless alla gestione degli elementi che compongono l’interfaccia, come si può apprezzare dal breve filmato di seguito che ne mostra il funzionamento a bordo di un veicolo. Potrebbero beneficiarne ad esempio le postazioni accessibili al pubblico, soprattutto in considerazione di quanto avvenuto di recente con ogni contatto ritenuto una potenziale occasione per la trasmissione di agenti patogeni.

Nel settore delle quattro ruote Predictive Touch potrebbe tornare utile soprattutto per evitare pericolose distrazioni a chi si trova al volante: riduce il margine d’errore negli input solitamente causato da buche, vibrazioni o altri fattori che si normalmente verificano mentre ci si trova alla guida, chiedendo al conducente di distogliere per qualche attimo lo sguardo dalla strada con tutto ciò che ne può conseguire. I primi test condotti hanno restituito risultati incoraggianti.

Un’altra applicazione del sistema potrebbe essere quella relativa ai dispositivi in dotazione a persone affette da patologie come il morbo di Parkinson o che comunque causano problemi nella coordinazione dei movimenti, semplificando loro i piccoli gesti della quotidianità. Al momento non è comunque dato a sapere quali siano le intenzioni legate a un debutto commerciale.

Una tecnologia simile è quella messa in cantiere negli anni scorsi da Google con Project Soli, sistema pensato per l’esecuzione e l’interpretazione delle gesture da parte dei dispositivi che non richiede alcun contatto fisico.