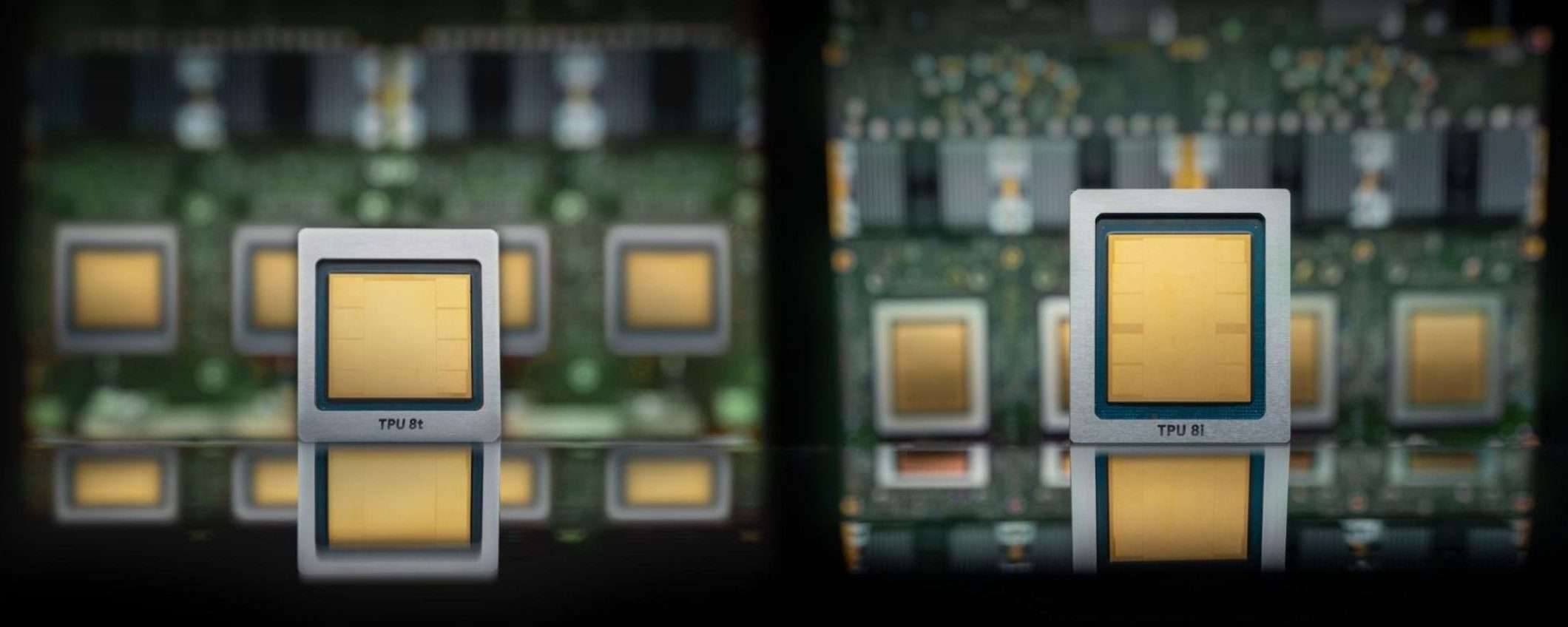

Per la prima volta, Google divide i suoi chip AI in due: uno per l’addestramento, TPU 8t, e uno per l’inferenza, TPU 8i. Le prestazioni dichiarate sono impressionanti: addestramento fino a 3 volte più veloce, un miglioramento dell’80% nel rapporto prestazioni/costo, e la capacità di far lavorare insieme oltre un milione di TPU in un singolo cluster. Ma prima di dare per spacciata NVIDIA, conviene fermarsi un attimo… Google non la sta rimpiazzando, la sta semplicemente affiancando.

I chip TPU 8t e TPU 8i

La separazione tra addestramento e inferenza è la novità più interessante. I due compiti, infatti, hanno esigenze computazionali diverse. L’addestramento richiede potenza bruta per elaborare enormi dataset per settimane; l’inferenza richiede latenza bassa e efficienza per rispondere a milioni di richieste al secondo. Avere chip ottimizzati per ciascun compito, invece di un chip generico che fa entrambi, dovrebbe tradursi in più potenza di calcolo con meno energia e costi inferiori per i clienti.

Google li chiama TPU (Tensor Processing Units), non GPU, perché i suoi chip custom a basso consumo sono stati chiamati “Tensor” fin dalla prima generazione.

NVIDIA resta centrale

Come gli altri grandi provider cloud, Microsoft e Amazon, Google usa i propri chip per integrare, non per sostituire, i sistemi NVIDIA che offre nella sua infrastruttura. Google ha anche confermato che il suo cloud avrà il chip più recente di NVIDIA, Vera Rubin, disponibile entro la fine dell’anno.

L’analista Patrick Moorhead ha scherzato su X ricordando che nel 2016, quando Google ha lanciato la prima TPU, aveva previsto che potesse essere una cattiva notizia per NVIDIA. NVIDIA oggi vale quasi 5.000 miliardi di dollari di capitalizzazione. La previsione non ha retto la prova del tempo.

Google e NVIDIA stanno anche collaborando per migliorare il networking tra i sistemi NVIDIA nel cloud Google, in particolare potenziando Falcon, la tecnologia di rete software che Google ha creato e reso open source nel 2023 sotto l’Open Compute Project.