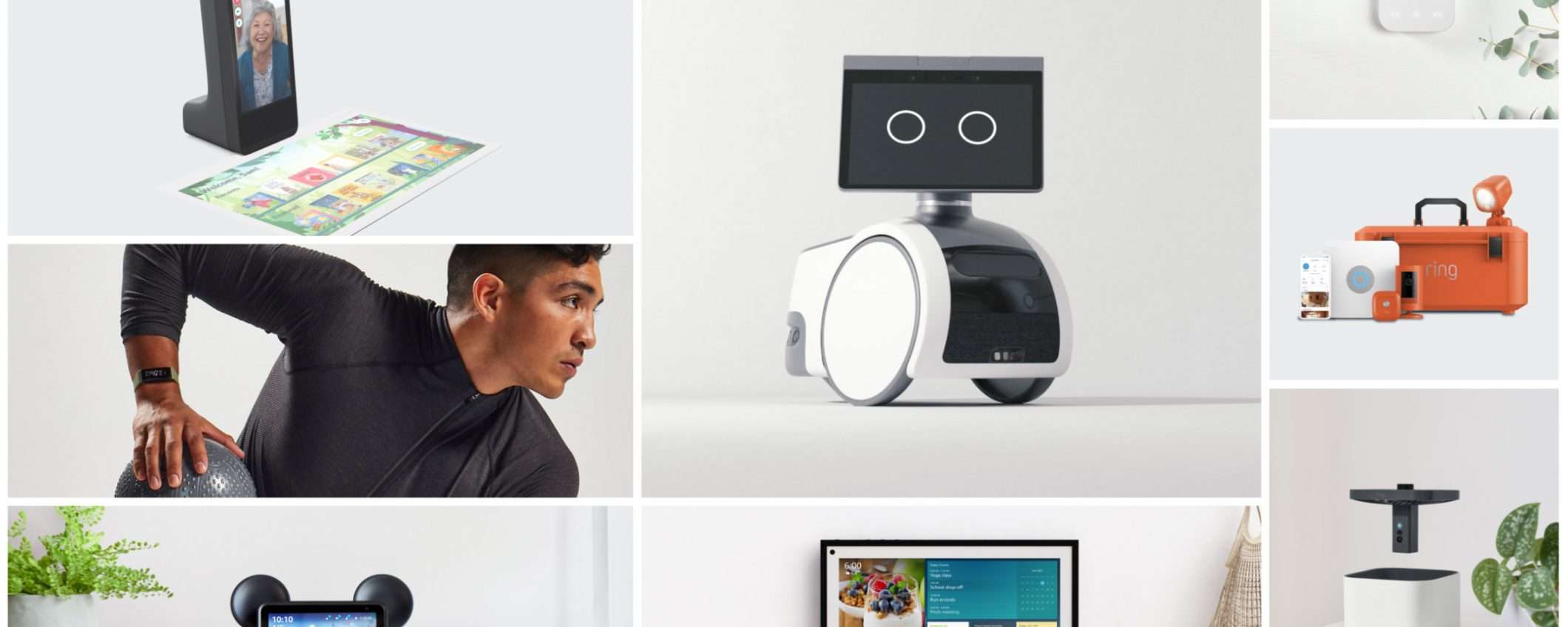

Tutti i dispositivi annunciati ieri da Amazon consentono di utilizzare le “skill” di Alexa. Durante l’evento virtuale sono state svelate nuove funzionalità che permettono all’assistente di riconoscere determinati suoni e di eseguire le azioni più appropriate. Inoltre, grazie al processore AZ1 Neural Edge, l’elaborazione dei comandi vocali verrà effettuata localmente su alcuni dispositivi Echo.

Alexa rileva i suoni nell’abitazione

Il nome della funzionalità più interessante è “Custom Sound Event Detection“. Gli utenti potranno insegnare ad Alexa a riconoscere determinati suoni nell’abitazione (ad esempio quello di un campanello) e di avviare la corrispondente routine. Amazon offre già il servizio Alexa Guard (solo negli Stati Uniti) che identifica la rottura di un vetro o l’allarme del rilevatore di fumo, ma la novità annunciata ieri estende la funzionalità a suoni non correlati a situazioni di emergenza.

L’utente deve innanzitutto “addestrare” Alexa con alcuni campioni sonori (da sei a dieci), sfruttando il microfono dei dispositivi Alexa o quello dello smartphone sul quale è installata l’app. Questa operazione richiede l’invio dei dati al cloud, ma la successiva rilevazione avviene localmente. Se, ad esempio, Alexa rileva l’apertura della porta di ingresso, viene eseguita la routine impostata (accensione della luce, riproduzione della musica o altro).

Un’altra novità è “Preference teaching“. L’utente può dire ad Alexa quali skill di terze parti deve usare per gestire determinati tipi di richieste e quali sono le sue preferenze per sport o cibo. Se, ad esempio, l’utente chiede informazioni sportive, Alexa fornirà più notizie sulla squadra preferita.

Nei prossimi mesi, Amazon utilizzerà il processore AZ1 Neural Edge per eseguire i comandi vocali sul dispositivo, quindi senza inviare dati al cloud. Le registrazioni audio verranno automaticamente cancellate dopo l’elaborazione. Inizialmente la novità sarà riservata agli utenti statunitensi con Echo Show 10 e Echo di quarta generazione.