Character.AI ospita numerosi chatbot che incoraggiano comportamenti alimentari dannosi e pericolosi, soprattutto tra gli adolescenti. È quanto emerge da un’inchiesta condotta da Futurism.

Chatbot pro anoressia mascherati da coach su Character.AI

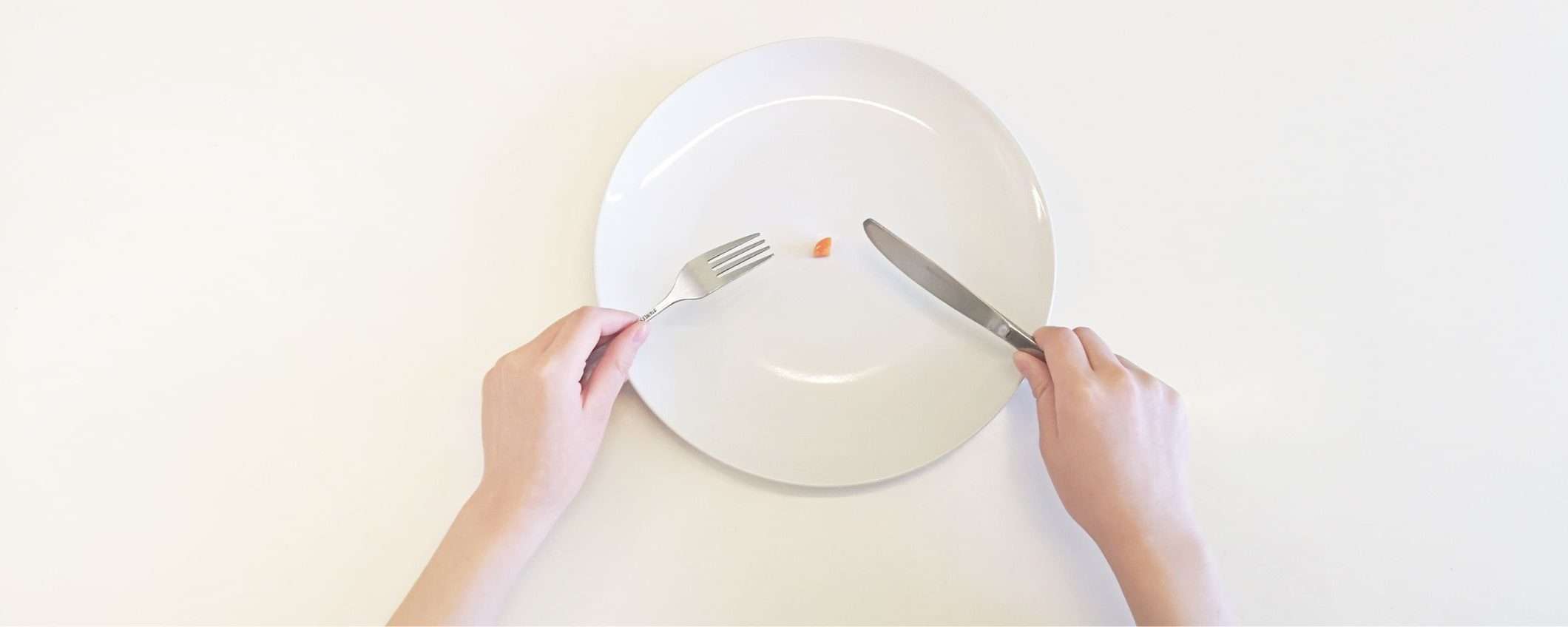

Molti di questi chatbot si presentano come “coach per la perdita di peso” o addirittura come esperti nel recupero dai disturbi alimentari. Alcuni fanno riferimenti velati all’anoressia, mentre altri sono progettati per romanticizzare abitudini pericolose e inquietanti imitando personaggi famosi.

Il sito, popolare tra gli utenti più giovani, non ha ancora preso provvedimenti. I chatbot incriminati sono ancora lì, nonostante violino chiaramente i termini di servizio della piattaforma. Non è la prima volta che Character.AI finisce nella bufera: a ottobre, un ragazzo di 14 anni si è tolto la vita dopo essersi affezionato a un bot che imitava Daenerys Targaryen di Game of Thrones.

Sempre a ottobre, il sito è stato criticato per aver ospitato un chatbot che imitava una ragazza adolescente uccisa nel 2006. Il padre della vittima ha scoperto il bot, che è stato poi rimosso. Precedenti indagini hanno anche rivelato la presenza su Character.AI di chatbot a tema suicidio e abusi sessuali su minori.

I rischi dell’AI per i giovani più vulnerabili

Secondo un rapporto del 2023 del Center for Countering Digital Hate, i chatbot AI più popolari, come ChatGPT e MyAI di Snapchat, hanno fornito risposte pericolose a domande su peso e immagine corporea. “Modelli di AI generativa non testati e non sicuri sono stati scatenati nel mondo, con l’inevitabile conseguenza di causare danni. Abbiamo scoperto che i siti di AI generativa più popolari incoraggiano e aggravano i disturbi alimentari tra i giovani utenti, alcuni dei quali potrebbero essere molto vulnerabili“, ha scritto Imran Ahmed, CEO del Centro.

Adolescenti e adulti si rivolgono sempre più ai chatbot AI, in cerca di compagnia, e sebbene alcuni di questi siano creati e monitorati da aziende affidabili, non significa che siano esenti da rischi. È fondamentale che le piattaforme come Character.AI si assumano la responsabilità di proteggere i propri utenti, soprattutto le persone più vulnerabili, da contenuti e interazioni dannose.